AIコード、実は危険?Claude脆弱性からWeb・AI開発を守る方法

AIコード生成の光と影:Claude Code脆弱性が示す教訓

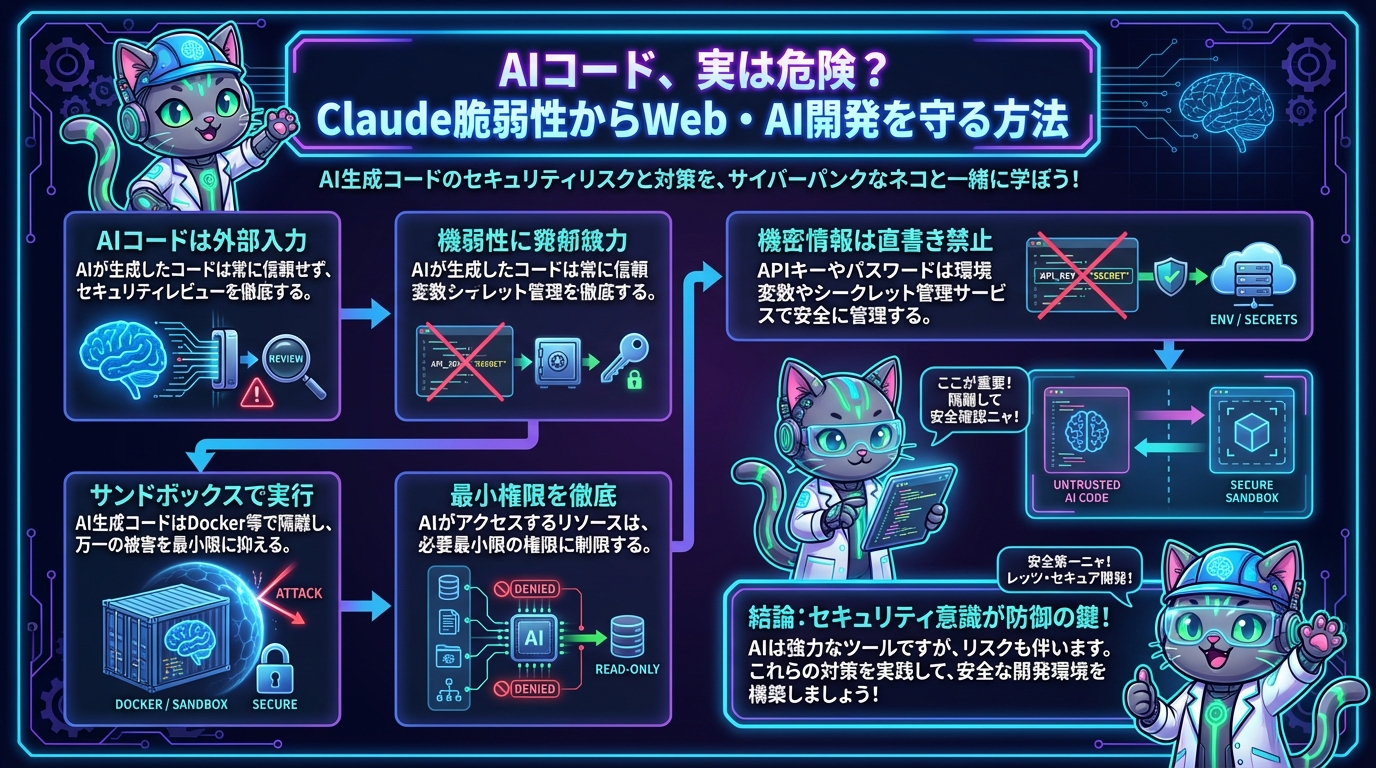

皆さん、こんにちは!Web制作とAI開発の最前線で奮闘するエンジニアの皆さん、今日のテーマはちょっと耳が痛いかもしれませんが、非常に重要な話です。最近、AIアシスタント「Claude Code」に重大な脆弱性が見つかったというニュースが飛び込んできましたね。設定ファイル経由でRCE(リモートコード実行)やAPIキー窃取の恐れがあるとのこと。これは、AIが生成するコードを鵜呑みにすることの危険性、そしてAI時代のセキュリティ対策の重要性を改めて私たちに突きつけています。

でも、心配はいりません!このニュースは単なるネガティブな情報ではなく、むしろ私たちがAIをより安全に、そしてスマートに活用するための「学びのチャンス」と捉えることができます。今回は、この脆弱性から得られる教訓を元に、開発者やWeb制作者がすぐに実践できるセキュリティ対策について、カジュアルかつ実用的に深掘りしていきましょう。

何ができるのか?AI時代のセキュア開発スキルを身につける

今回のClaude Codeの脆弱性報道から、私たちは主に以下のスキルや知識を習得できます。

- AI生成コードのセキュリティリスクを正しく理解する力: AIが生成するコードは「完璧ではない」という前提に立ち、どのような潜在的なリスクがあるのかを把握します。

- 機密情報の安全な管理方法: APIキーやデータベース接続情報など、設定ファイルに直書きする危険性を認識し、よりセキュアな管理手法を導入する知識です。

- RCEなどの深刻な攻撃からシステムを守る防御策: リモートコード実行という最悪のシナリオを回避するための具体的な技術的対策を学びます。

- AIを安全に開発・運用するためのベストプラクティス: AIを活用した開発プロセス全体にセキュリティの視点を取り入れる方法です。

これらのスキルは、これからのAIが当たり前になる時代において、開発者として必須の「護身術」とも言えるでしょう。AIの恩恵を最大限に享受しつつ、そのリスクを最小限に抑えるための知恵を一緒に身につけていきましょう!

どう使えるのか?具体的な対策と実践例

では、具体的にどのようにしてこれらの知識を日々の開発に活かしていけば良いのでしょうか?いくつか実践的なアプローチをご紹介します。

1. AI生成コードは「信頼できない外部入力」と心得よ

AIが生成したコードは、まるでインターネットからコピペしてきたコードのように、常に「信頼できない外部入力」として扱うのが鉄則です。特に以下の点に注意してコードレビューを行いましょう。

- ファイルI/O操作: 任意のファイルを読み書きする可能性がないか。

- ネットワーク通信: 不審な外部IPアドレスへの接続や、予期せぬポート開放がないか。

- シェルコマンド実行: `exec`, `system`, `subprocess`など、OSコマンドを実行する関数に悪意のある入力が与えられていないか。

- 環境変数へのアクセス: 機密情報が含まれる環境変数をAIが無許可で参照・出力していないか。

これらはすべて、今回のClaude Codeの脆弱性で問題となったRCEやAPIキー窃取に繋がりかねない要素です。AIが提案するコードであっても、必ず人間の目と手でセキュリティレビューを行う習慣をつけましょう。

2. 機密情報の管理は「設定ファイル直書き禁止」を徹底

APIキーやデータベースのパスワードなどを設定ファイルに直接書き込むのは、非常に危険な行為です。Gitに誤ってコミットしてしまえば、情報漏洩のリスクは計り知れません。以下の方法で機密情報を管理しましょう。

- 環境変数: 最も手軽な方法です。`.env`ファイルを使う場合は、必ず`.gitignore`に追加し、Gitにコミットしないようにしましょう。

- シークレット管理サービス: AWS Secrets Manager, Google Cloud Secret Manager, Azure Key Vaultなど、クラウドプロバイダーが提供するサービスを活用します。CI/CDパイプラインと連携させることで、安全かつ自動的に機密情報をアプリケーションに注入できます。

- HashiCorp Vault: 自身でシークレット管理基盤を構築したい場合に強力な選択肢となります。

これらのツールを使うことで、機密情報をコードや設定ファイルから分離し、セキュリティリスクを大幅に低減できます。

3. AI生成コードはサンドボックス環境で実行・テスト

AIが生成したコードは、いきなり本番環境や開発環境で実行するのではなく、隔離されたサンドボックス環境でテストするのが理想的です。Dockerコンテナや仮想マシンを活用し、インターネットアクセスを制限したり、特定のファイルシステムへのアクセスを禁止したりすることで、万が一悪意のあるコードが含まれていても被害を最小限に抑えられます。

- Dockerコンテナ: 最も手軽なサンドボックス化の手法です。Dockerfileで実行環境を厳密に定義し、不要な権限を与えないようにしましょう。

- 仮想マシン: より強固な隔離が必要な場合に有効です。

特にWebアプリケーションの一部としてAI生成コードを動的に実行するようなシステムでは、このサンドボックス化は必須の対策となります。

4. 最小権限の原則を徹底

AIが生成するコードや、AIサービス自体がアクセスできるリソースは、必要最小限の権限に制限する「最小権限の原則」を徹底しましょう。例えば、特定のS3バケットへの読み取り権限のみを与える、特定のAPIエンドポイントへのアクセスのみを許可するなどです。これにより、万が一AIが悪意のあるコードを生成してしまった場合でも、その被害範囲を限定することができます。

試すならどこから始めるか?具体的な第一歩

「よし、やってみよう!」と思ったあなたのために、いますぐ始められる具体的なステップをいくつか提案します。

- 自身のプロジェクトでAIコード利用箇所を洗い出す: まずは、あなたのプロジェクトでAI(ChatGPT, Claude, Copilotなど)が生成したコードをどこで、どのように使っているかをリストアップしてみましょう。特に、設定ファイルや機密情報にアクセスする可能性のある部分に注目です。

- `.env`ファイルと`.gitignore`を見直す: 環境変数を使っている場合は、`.env`ファイルが正しく`.gitignore`に記述されているかを確認してください。まだ環境変数を使っていないなら、APIキーなどの機密情報を環境変数に移行する最初のステップを踏み出しましょう。

- 簡単なDockerサンドボックスを試す: 試しに、AIに簡単なPythonスクリプトを生成させ、それをDockerコンテナ内で実行してみましょう。コンテナのネットワークアクセスを制限したり、特定のディレクトリにしかアクセスできないように設定を変えてみたりすることで、サンドボックスの感覚を掴めます。

- OWASP Top 10 for LLM Applicationsを読んでみる: AIアプリケーション特有のセキュリティリスクをまとめた「OWASP Top 10 for LLM Applications」は、AI時代のセキュリティ対策を学ぶ上で非常に役立ちます。ぜひ一読してみてください。

- CI/CDパイプラインにセキュリティスキャンを組み込む: もしCI/CDを導入しているなら、コード品質ツール(ESLint, Blackなど)だけでなく、静的解析ツール(Snyk, SonarQubeなど)やシークレットスキャンツール(GitGuardianなど)を組み込むことを検討しましょう。これにより、セキュリティ上の問題が早期に発見できます。

AIは私たちの開発を強力にサポートしてくれる素晴らしいツールです。しかし、その力を最大限に引き出すためには、セキュリティという土台が不可欠です。今回のClaude Codeの脆弱性報道をきっかけに、皆さんのプロジェクトがより安全で堅牢なものになることを願っています。さあ、AI時代のセキュア開発、一緒に楽しみながらマスターしていきましょう!