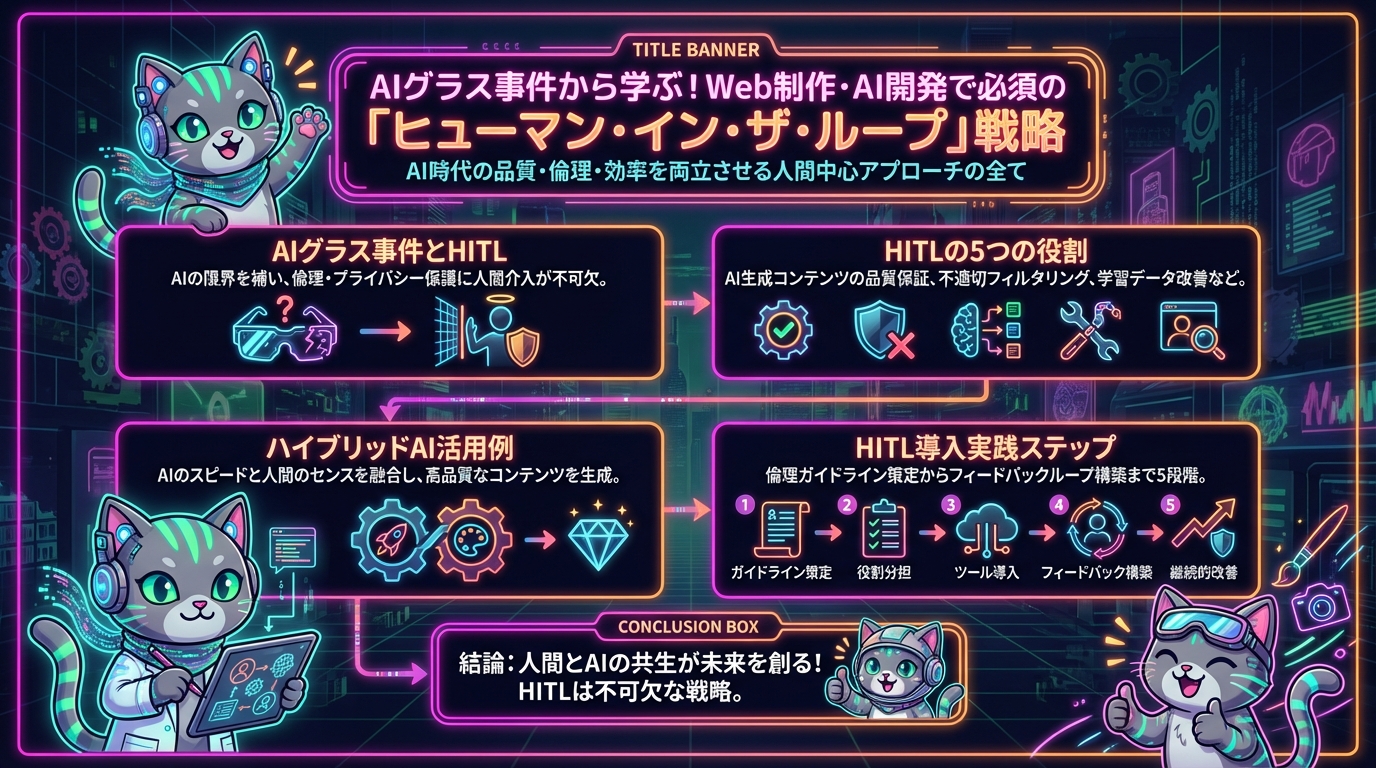

AIグラス事件から学ぶ!Web制作・AI開発で必須の「ヒューマン・イン・ザ・ループ」戦略

こんにちは!Web制作とAI開発の最前線を駆け抜ける皆さん、いかがお過ごしでしょうか?

最近、MetaのAIグラスが撮影した映像の一部が、ケニアの人間のレビュー担当者に送られていたというニュースが話題になりましたね。一見するとプライバシー侵害のように聞こえるかもしれませんが、これはAIシステムの運用において避けて通れない「ヒューマン・イン・ザ・ループ(Human-in-the-Loop, HITL)」という考え方の一端を示しています。

特に、画像生成AIをWebサービスに組み込む際、このHITLの概念は非常に重要になります。今回は、このAIグラスの事例から学び、開発者やWeb制作者が実践できる安全で信頼性の高い画像生成AI活用術について深掘りしていきましょう!

AIグラス事件から学ぶ、ヒューマン・イン・ザ・ループの真髄

MetaのAIグラスの事例は、AI技術がどれだけ進化しても、その判断が完璧ではないこと、特にプライバシーや倫理が絡むデリケートな情報においては人間の最終確認が不可欠であることを浮き彫りにしました。

AIは大量のデータを高速で処理し、パターンを認識する能力に優れています。しかし、文脈の深い理解、倫理的な判断、微妙なニュアンスの把握といった領域では、依然として人間が優位に立っています。画像生成AIにおいても、このギャップは顕著です。意図しない差別的な表現、不適切な内容、あるいは著作権に抵触する可能性のある画像を生成してしまうリスクは常に存在します。これらを未然に防ぎ、あるいは事後に適切に対処するために、人間の介入(ヒューマン・イン・ザ・ループ)が必要となるのです。

Web制作・AI開発で「ヒューマン・イン・ザ・ループ」は何ができるのか?

では、具体的にWebサービスやAI開発において、HITLはどのような役割を果たせるのでしょうか?

- AI生成コンテンツの品質保証: 生成された画像が、ブランドのデザインガイドラインやイメージに合致しているか、人間が最終的にチェックします。AIはあくまで候補を出す役割、最終的な「良し悪し」は人間が判断します。

- 不適切コンテンツのフィルタリング: 差別的、暴力的、性的な表現など、プラットフォームのガイドラインに反する画像をAIが一次スクリーニングし、判断が難しいケースや重要なケースは人間が最終判断を下します。これにより、ユーザーに安全なコンテンツを提供できます。

- 学習データの品質向上: AIモデルの学習データに偏りや不正確な情報が混入していないか、人間がレビューし、修正することで、より公平で高品質なAIモデルを育成できます。これはAIの「倫理」を育む上で非常に重要です。

- AIの判断が難しいケースの補完: 曖昧な指示や複雑な状況下でのAIの生成結果を人間が評価し、AIの弱点を補完します。これにより、AIの信頼性と応用範囲が広がります。

- ユーザー体験の向上と信頼獲得: ユーザーが安心して画像生成AIを利用できる環境を提供することで、サービスの信頼性が向上し、ブランドイメージも強化されます。「このサービスはちゃんと人間が目を通しているから安心だ」という感覚は、ユーザーにとって非常に重要です。

具体例!Webサービスで「ハイブリッドAI」をどう使う?

開発者やWeb制作者の皆さんが、画像生成AIとHITLを組み合わせた「ハイブリッドAI」をどのように活用できるか、具体的な例を見ていきましょう。

- ブログ記事用アイキャッチ画像生成サービス:

ユーザーが記事の内容を入力すると、AIが複数のアイキャッチ画像を生成します。その中から、人間が最も記事の意図に合い、魅力的で、かつ著作権問題のない画像を選定し、必要に応じて微調整を指示します。これにより、AIの「スピード」と人間の「センス・倫理観」が融合した高品質なアイキャッチが手に入ります。 - ECサイトの商品画像バリエーション生成:

基本の商品画像から、AIが異なる背景、モデル、着用シーンなどのバリエーション画像を生成します。その後、人間がブランドイメージに合致するもの、購買意欲を高めるもの、不適切な表現がないかなどを選定・修正します。例えば、ファッションECでAIが生成したモデル着用画像を、最終的に人間のスタイリストやマーケターがチェックするイメージです。 - アバター・プロフィール画像生成ツール:

ユーザーの要望に基づいてAIがアバター画像を生成するサービスでは、公開前に人間が不適切な表現や著作権侵害の可能性がないかをチェックするフローが不可欠です。特にUGC(User Generated Content)を扱うサービスでは、このモデレーションがサービスの健全性を保つ上で非常に重要になります。 - Webサイトのコンテンツモデレーション:

掲示板やコメント欄に投稿された画像や動画コンテンツをAIが自動で検出し、不適切度が高いものは自動削除、中程度のものは人間のモデレーターに回します。モデレーターはAIの判断を参考にしつつ、最終的な判断を下すことで、モデレーション業務の効率化と精度向上を両立させます。

さあ、実践!どこから「ハイブリッドAI」を始めるか?

「よし、HITLを取り入れてみよう!」と思っても、どこから手をつければいいか迷うかもしれません。ここでは、実践的なステップをいくつかご紹介します。

- ステップ1: 倫理ガイドラインの策定:

まず、あなたのサービスで「何が良くて何がダメか」を明確にする倫理ガイドラインを策定しましょう。これはAIだけでなく、人間のレビュー担当者にとっても判断基準となり、一貫した運用を可能にします。例えば、「差別的な表現は禁止」「著作権侵害の可能性のある画像はNG」といった具体的なルールを定めます。 - ステップ2: 既存のAIモデレーションAPIの活用:

OpenAIのModeration APIやGoogle CloudのContent Moderation APIなどを利用して、AIによる一次スクリーニングを導入しましょう。これにより、人間のレビュー負担を大幅に軽減し、より重要な判断に集中できるようになります。 - ステップ3: 小規模なレビュー体制の構築:

まずは社内のチームで、生成AIの出力結果を定期的にレビューする習慣をつけましょう。プロジェクトが大きくなれば、Amazon Mechanical Turk、CrowdWorks、ランサーズなどのクラウドソーシングサービスを活用し、外部のレビュー担当者を活用することも検討できます。 - ステップ4: 透明性の確保とユーザーへの説明:

「この画像はAIが生成し、人間のレビューを経て公開されています」といったメッセージをWebサイトに表示することで、ユーザーの信頼を得られます。プライバシーポリシーに、人間によるレビューの可能性を明記することも重要です。 - ステップ5: フィードバックループの構築:

人間のレビュー結果をAIモデルの学習データにフィードバックし、AIの精度を継続的に改善する仕組みを作りましょう。これにより、AIはより賢く、より倫理的な判断ができるようになります。このサイクルを回すことで、サービスの品質は飛躍的に向上します。

まとめ:AIと人間の「共創」が未来を拓く

MetaのAIグラスの事例は、AI技術が進化する中で、人間の役割が決してなくならないどころか、ますます重要になることを示唆しています。特に画像生成AIをWebサービスに組み込む開発者やWeb制作者にとって、AIの能力を最大限に引き出しつつ、倫理的、社会的な責任を果たすためには、ヒューマン・イン・ザ・ループの設計が不可欠です。

AIと人間がそれぞれの得意分野を活かし、協力し合う「ハイブリッドAI」の戦略こそが、ユーザーに安心と信頼を提供する、持続可能なWebサービスを構築する鍵となるでしょう。さあ、皆さんも今日から「AIと人間の共創」を意識した開発を始めてみませんか?