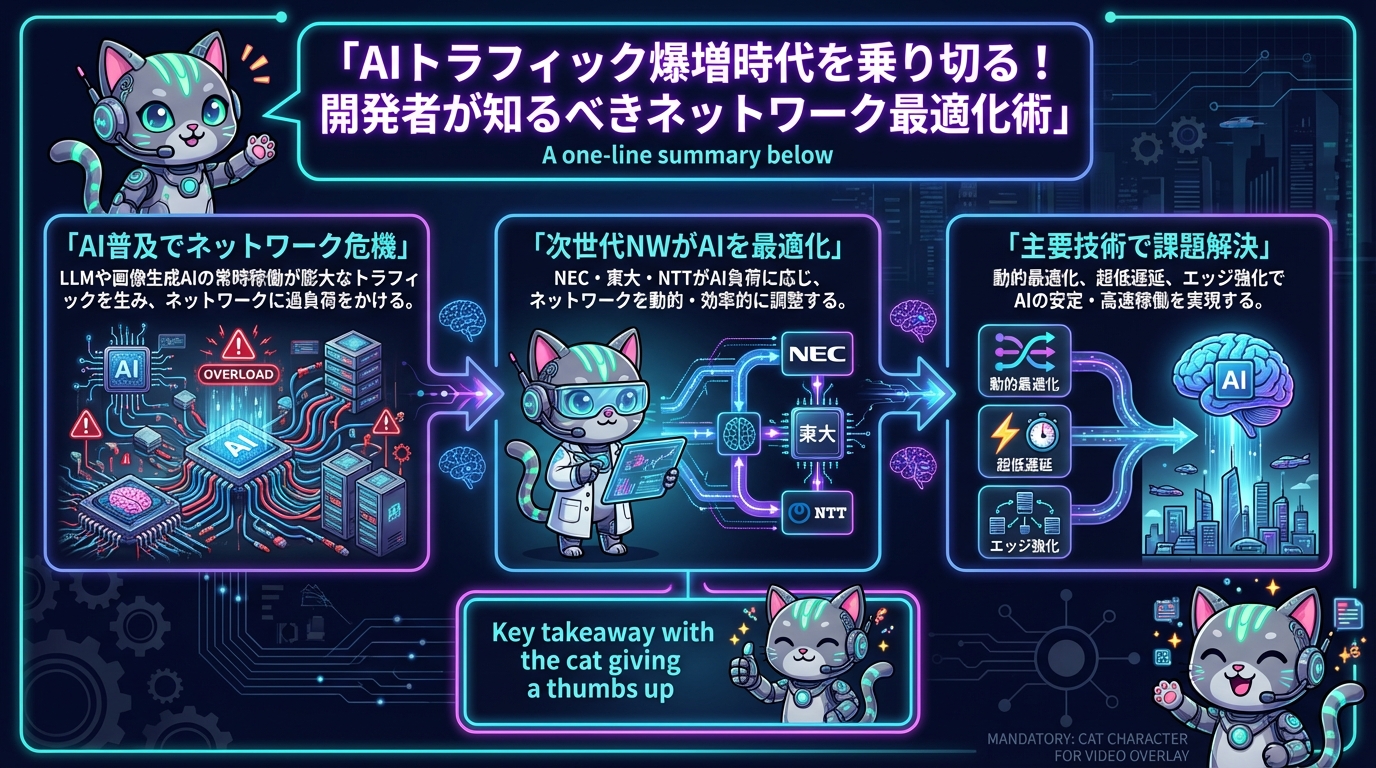

AIトラフィック爆増時代を乗り切る!開発者が知るべきネットワーク最適化術

AIの常時稼働が引き起こすネットワーク危機!

皆さん、こんにちは!Web制作とAI開発の最前線で奮闘するエンジニアの皆さん、最近AIの進化にワクワクしつつも、ある懸念を抱いていませんか?そう、「このままAIが常時稼働したら、ネットワークはどうなっちゃうの!?」という問題です。

ChatGPTをはじめとするLLM(大規模言語モデル)の普及、画像生成AI、リアルタイム翻訳、自動運転…AIは私たちの生活やビジネスに欠かせない存在になりつつあります。しかし、その裏側では膨大なデータが常にやり取りされ、ネットワークにこれまで経験したことのない負荷をかけています。

もし、このトラフィック問題が解決されなければ、AIサービスは遅延したり、コストが高騰したり、最悪の場合サービスそのものが停止する可能性も。これはWeb制作者にとっても、AI開発者にとっても、まさに死活問題ですよね。

そんな中、日本の技術力の粋を集めた取り組みが注目されています。NEC、東京大学、NTTといった日本のトップランナーたちが結集し、AIの常時稼働によるトラフィック激増にどう対応するか、そのための次世代ネットワーク技術の開発を進めているんです。これはまさに、未来のWeb・AIサービスを支える基盤となる技術革新と言えるでしょう。

今回は、この壮大なプロジェクトの背景にある課題と、私たち開発者・Web制作者が今から知っておくべき、そして活用すべきネットワーク最適化のヒントについて、カジュアルかつ実用的に深掘りしていきます!

次世代ネットワークが「何ができるのか」?

NEC・東大・NTTが目指すのは、AIがどれだけ稼働しても安定し、高速に、そして効率的に動作するネットワークです。具体的には、以下のような未来が実現されると期待されています。

- ネットワークリソースの動的最適化:AIの負荷に応じて、ネットワーク帯域や処理能力をリアルタイムで自動調整。必要な時に必要なだけリソースを供給し、無駄をなくします。

- 超低遅延・高信頼性通信:自動運転や遠隔医療など、ミリ秒単位の遅延が許されないAIアプリケーションでも、安定した通信を保証。これは「ネットワークスライシング」という技術で、仮想的に専用回線のようなネットワークを構築することで実現されます。

- エッジコンピューティングの強化:データが発生する場所(エッジ)でAI処理の一部を行うことで、クラウドへのデータ転送量を減らし、遅延を大幅に削減。これにより、より高速なリアルタイムAI処理が可能になります。

- 省電力化と持続可能性:AIによるネットワーク制御そのものも効率化し、消費電力を抑制。持続可能な社会インフラとしてのネットワークを目指します。

- AIによるトラフィック予測と制御:ネットワーク自体がAIを活用し、将来のトラフィックを予測して事前にリソースを準備したり、ボトルネックを回避したりする能力を持つようになります。

要するに、AIの要求に合わせてネットワークが賢く、しなやかに、そしてパワフルに変化するようになる、ということですね!これはまさに、AIのためのAIと言えるかもしれません。

開発者は「どう使えるのか」?具体的な活用例

この次世代ネットワーク技術が普及すれば、私たちの開発スタイルや提供できるサービスは大きく変わります。今から意識しておきたい活用例を見ていきましょう。

Web制作・フロントエンド開発の視点

- 超高速Webアプリケーションの実現:

現在のWebサイトでもCDNや画像最適化は必須ですが、将来的にはリアルタイム性の高いWebRTCベースのコミュニケーションツールや、WebAssembly (Wasm) を活用した複雑な処理も、より快適に動作するようになります。ユーザー体験(UX)の劇的な向上が期待できます。 - エッジファンクションの積極的活用:

Next.jsのEdge FunctionsやCloudflare Workersのようなエッジコンピューティングのサービスは、まさにこの流れを先取りしています。ユーザーに最も近い場所で処理を行うことで、APIレスポンスの高速化やパーソナライズされたコンテンツの提供が、より容易かつ効率的になります。 - リッチコンテンツの増加と最適化:

高解像度の画像、4K/8K動画、3Dモデルなど、リッチなコンテンツが増えても、ネットワーク側で自動的に最適化され、ストレスなく配信されるようになります。WebPやAVIFといった次世代画像フォーマットへの対応は、引き続き重要です。

AI開発・バックエンド開発の視点

- 分散型AI推論の実現:

大規模なLLMでも、推論処理の一部をエッジデバイスや近傍のサーバーで行うことで、クラウドへの依存を減らし、低遅延でリアルタイムなAI応答が可能になります。例えば、スマートデバイスでの音声アシスタントや、工場でのリアルタイム異常検知など、応用範囲が広がります。 - リアルタイムAIサービスの強化:

画像認識、音声認識、自然言語処理など、リアルタイム性が求められるAIサービスは、ネットワークのボトルネックに悩まされがちでした。次世代ネットワークは、これらのAIサービスが持つ本来の性能を最大限に引き出すための基盤となります。 - IoT・MaaSの進化:

数多くのIoTデバイスから収集される膨大なデータの処理や、自動運転車同士の連携など、MaaS(Mobility as a Service)のような分野では、超低遅延・高信頼性通信が不可欠です。AIとネットワークの融合が、これらの未来型サービスを現実のものにします。 - GPUリソースの効率的利用:

バックエンドのGPUサーバーも、ネットワークの最適化によって、より効率的にAIモデルの学習や推論に集中できるようになります。リソースの無駄が減り、運用コストの削減にも繋がります。

試すならどこから始めるか?今すぐできること、未来への準備

「すごい技術だけど、まだ先の話でしょ?」と思うかもしれません。しかし、この技術の恩恵を最大限に受けるためには、今からできる準備がたくさんあります。未来を見据え、一歩ずつ行動していきましょう!

今すぐできる実践的なステップ

- 既存サービスのネットワークパフォーマンス改善:

まずは足元から。Google LighthouseやWeb Vitalsを活用して、現在のWebサイトやアプリケーションのパフォーマンスを診断しましょう。CDNの導入・最適化、画像・動画の圧縮(WebP/AVIFへの変換)、JavaScript/CSSの最適化、遅延読み込み(Lazy Load)の実装など、基本的な対策を徹底するだけでも効果は絶大です。 - サーバーレスアーキテクチャの検討:

AWS Lambda, Google Cloud Functions, Azure Functionsなどのサーバーレスサービスは、必要な時に必要なだけリソースが割り当てられるため、トラフィックの変動に強く、コスト効率も良いです。AIの推論APIなど、特定の処理をサーバーレスで実行することを検討しましょう。 - エッジコンピューティングのPoC (Proof of Concept) :

Cloudflare WorkersやVercel Edge Functionsを使って、簡単なAPIやコンテンツの一部をエッジで処理するPoCを試してみましょう。ユーザーからのリクエストを最も近いエッジで受け止め、処理することで、体感速度の向上を実感できるはずです。 - ネットワークモニタリングの強化:

Datadog, New Relic, Prometheusなどのツールを活用し、サービスのネットワークトラフィックやレイテンシを常に監視しましょう。ボトルネックを早期に発見し、改善サイクルを回すことが重要です。

未来への準備・学習リソース

- 次世代ネットワーク技術の動向を追う:

5G/6G、ネットワークスライシング、プログラマブルネットワーク、AI-driven Network Automationといったキーワードで、各通信キャリアや研究機関の発表をチェックしましょう。特に、NEC・東大・NTTの共同研究の進捗は要注目です。 - クラウドプロバイダーのエッジサービスを深掘り:

AWS Outposts, Azure Stack Edge, Google Distributed Cloud Edgeなど、各クラウドベンダーが提供するエッジコンピューティングソリューションについて学習し、自社のAIサービスやWebアプリケーションへの適用可能性を検討しましょう。 - 分散型AIフレームワークのリサーチ:

TensorFlow Lite, OpenVINO, ONNX Runtimeなど、エッジデバイスでのAI推論を効率化するためのフレームワークについて学び、AIモデルの軽量化や最適化に取り組む準備をしておきましょう。

AIの常時稼働が当たり前になる未来は、もうすぐそこです。この大きな変化をチャンスと捉え、ネットワーク技術の進化を味方につけることで、私たちはより革新的で高性能なWebサービスやAIアプリケーションを開発できるようになります。

「AIのせいでネットワークがパンクする!」と悲観するのではなく、「AIのためにネットワークも進化する!」というポジティブな視点で、一緒に未来を創っていきましょう!