AI視覚検索の裏側を解剖!Web制作・AI開発で爆速実装の秘訣

AIが私たちの生活に深く根ざし、特に視覚情報とのインタラクションは日々進化していますね。Google検索で画像をアップロードして類似のアイテムを探したり、スマホのカメラで写したものが何なのかをAIが教えてくれたり。これって、もはや魔法のようですが、その裏側にはどんな技術が隠されているのでしょうか?

Web制作やAI開発に携わる私たちにとって、この「AIが視覚情報を理解する力」は、単なる便利な機能に留まりません。新しいサービスやプロダクトを生み出す強力な武器になり得るんです。

この記事では、Googleの「Ask a Techspert」で語られているようなAI視覚検索の仕組みを深掘りしつつ、Web制作者やAI開発者の皆さんが「これ、うちのプロジェクトで使えるかも!」「よし、試してみよう!」と感じるような、具体的な活用方法と実践ステップをご紹介します。さあ、AI視覚検索の魔法の扉を開いて、あなたのクリエイティブなアイデアを爆速で実装するヒントを見つけましょう!

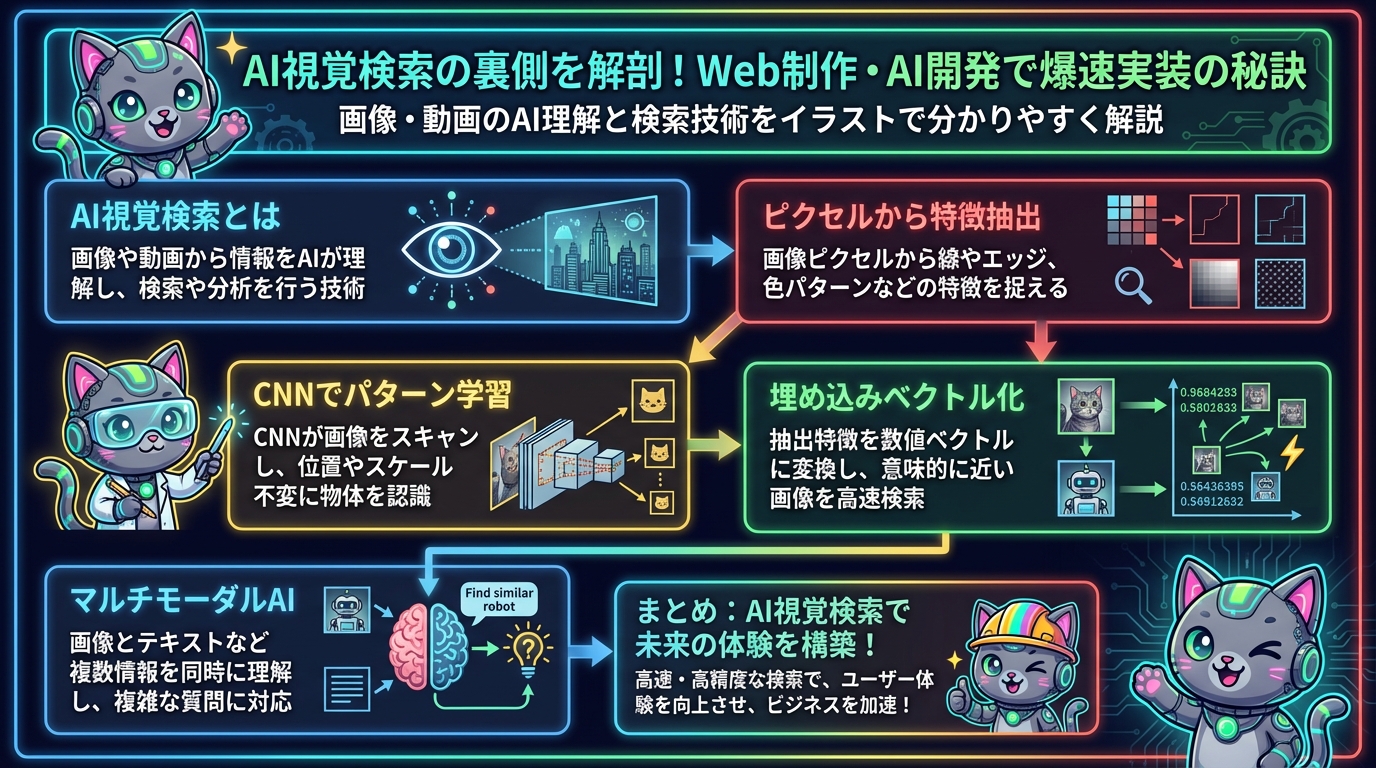

AIは視覚情報をどう理解しているのか?その魔法の裏側

AIが画像や動画といった視覚情報を理解するプロセスは、人間が物を見る仕組みと似ているようで、実は全く異なります。GoogleのAIがどのように視覚検索を「理解」しているのか、その核心に迫りましょう。

1. ピクセルからの特徴抽出

画像は、色のついた点の集まり、つまりピクセルデータです。AIはまず、この膨大なピクセルデータから、「特徴」を抽出します。例えば、線の方向、エッジ、色のパターン、テクスチャなどです。初期の層では単純な特徴を捉え、深い層に進むにつれて、より複雑な形状やオブジェクトのパーツ(目、鼻、車輪など)を認識するようになります。

2. 畳み込みニューラルネットワーク(CNN)の威力

この特徴抽出に中心的な役割を果たすのが、畳み込みニューラルネットワーク(Convolutional Neural Network, CNN)です。CNNは、人間の視覚野の仕組みを模倣した多層のニューラルネットワークで、画像を小さなフィルター(畳み込みカーネル)でスキャンし、重要なパターンを効率的に学習します。これにより、画像がどこにあっても(位置不変性)、多少の回転やスケール変更があっても(スケール不変性)、同じ物体として認識できるようになります。

3. 埋め込みベクトル(Embeddings)による意味の数値化

抽出された特徴は、最終的に「埋め込みベクトル(Embeddings)」と呼ばれる高次元の数値の配列に変換されます。このベクトルは、画像が持つ意味や概念を抽象的に表現したものです。重要なのは、意味的に近い画像同士は、このベクトル空間内で互いに近くに配置されるという点です。例えば、猫の画像と猫の画像は近いベクトルを持ち、犬の画像とは少し離れたベクトルを持つ、といった具合です。

Googleの視覚検索では、ユーザーがアップロードした画像の埋め込みベクトルを計算し、データベースに格納された数千億枚の画像の中から、最もベクトルが近い画像を高速に探し出すことで、類似画像や関連情報を提示しています。

4. マルチモーダルAIの進化

さらに進化したAIは、画像だけでなくテキスト、音声など複数のモダリティ(情報形式)を同時に理解できるようになりました。これがマルチモーダルAIです。GoogleのGeminiのようなモデルは、画像とテキストを同じ埋め込みベクトル空間で扱うことができます。これにより、「この写真の料理のレシピを教えて」「この写真に写っている植物の名前は何?」といった、画像とテキストを組み合わせた複雑な質問にも正確に答えることが可能になります。これは、Web検索の未来を大きく変える可能性を秘めています。

Web制作・AI開発で「これ使えそう!」な具体例

AIが視覚情報を理解する仕組みが分かったところで、私たちWeb制作者やAI開発者が、この技術をどう実用的に活用できるのか、具体的なアイデアを見ていきましょう。

Web制作の効率化とUX向上

- コンテンツ管理の自動化:

ECサイトの商品画像、ブログのアイキャッチ画像など、大量の画像をアップロードする際に、AIが自動でタグ付け、カテゴリ分類、さらには不適切な画像の検出まで行えます。手作業による負担を大幅に削減し、検索性を向上させます。 - アクセシビリティの向上:

視覚障害者向けに、画像のaltテキストをAIが自動生成できます。これにより、Webサイトのアクセシビリティ要件を満たしやすくなり、より多くのユーザーに情報が届くようになります。 - 革新的な検索体験の提供:

ユーザーが画像やスクリーンショットをアップロードするだけで、類似の商品やスタイル、関連するブログ記事などを検索できる「視覚検索機能」を実装できます。ファッションECサイトやインテリアサイトでは特に強力な武器となるでしょう。 - パーソナライズされたコンテンツ推薦:

ユーザーが閲覧した画像コンテンツの傾向をAIが分析し、視覚的に似た商品や記事、デザイン事例などを自動で推薦。ユーザーエンゲージメントを高めます。 - デザイン支援と品質保証:

Webサイトのデザイン案をAIに読み込ませ、レイアウトのバランス、配色、デザインガイドラインとの適合性などを自動でチェック。デザイナーの作業効率を上げ、品質のばらつきを抑えます。

AI開発の加速と新機能創出

- カスタム画像認識モデルの構築:

特定の業界(医療、製造、農業など)に特化した物体検出、異常検知、品質検査システムを開発。例えば、工場の製造ラインで不良品をリアルタイムで検知したり、農作物病害を早期発見したりできます。 - データセット作成・拡張の効率化:

AIモデルの学習には質の高いデータセットが不可欠です。AI視覚技術を使って、画像データに自動でアノテーション(ラベル付け)を行ったり、既存データから類似画像を生成してデータセットを拡張したりすることで、開発期間を短縮できます。 - マルチモーダル検索システムの開発:

画像とテキスト、あるいは音声と画像を組み合わせた、より高度な検索・情報抽出システムを構築。例えば、医療画像をアップロードして関連論文を検索し、その画像の特徴をテキストで説明させるようなシステムです。 - AR/VRアプリケーションへの応用:

リアルタイムの物体認識や環境理解をAR/VRアプリに組み込むことで、より没入感のある体験を提供できます。例えば、スマホをかざすと目の前の物体に関する情報が表示されたり、仮想オブジェクトを現実空間に自然に配置したりできます。 - 生成AIとの連携強化:

テキストから画像を生成するだけでなく、特定の画像スタイルを学習させて新たな画像を生成したり、既存の画像をAIが編集・加工したりする機能の開発に繋がります。

今日から始める!AI視覚検索技術の活用ステップ

「よし、やってみよう!」と思ったあなたのために、具体的な第一歩をご紹介します。

1. まずはAPIから試す

自社でゼロからモデルを構築するのは大変です。まずは、GoogleやOpenAIが提供する強力なAPIを活用して、AI視覚検索の力を体験してみましょう。

- Google Cloud Vision AI:

Googleが培ってきた画像認識技術をAPIとして利用できます。画像からのテキスト抽出(OCR)、顔検出、物体検出、不適切コンテンツの検出、ロゴ検出など、幅広い機能が提供されており、Webサイトやアプリへの組み込みが非常に容易です。ドキュメントも充実しているので、初心者でも始めやすいでしょう。 - OpenAI API (GPT-4Vなど):

GPT-4V(Vision)のようなマルチモーダルモデルのAPIを利用すれば、画像とテキストを組み合わせた複雑な質問応答や、画像の内容を詳細に分析する機能を手軽に実装できます。ユーザーとのインタラクションを重視するアプリケーションに最適です。 - Hugging Face:

数多くのオープンソースのAIモデルが公開されており、既存のSOTA(State-Of-The-Art)モデルを試したり、ファインチューニングして独自のタスクに適用したりできます。画像分類、物体検出、セグメンテーションなど、様々なタスクに対応したモデルが見つかります。

2. 低コード/ノーコードツールで手軽に体験

プログラミングの知識が少なくても、AI視覚認識を試せるツールもあります。

- Google Teachable Machine:

Webブラウザ上で、画像、音声、ポーズの認識モデルを簡単に作成・学習できるツールです。自分で集めた画像を使って、カスタムの画像分類器を数分で作れます。プログラミングなしでAIの仕組みを体験するのに最適です。 - Firebase ML Kit:

モバイルアプリ開発者向けに、画像認識、テキスト認識、顔検出などのAI機能を簡単にアプリに統合できるSDKです。iOS/AndroidアプリにAI機能を素早く追加したい場合に非常に便利です。

3. フレームワークで深く学ぶ

より高度なカスタムモデルを開発したい場合は、主要な機械学習フレームワークを学ぶのが王道です。

- TensorFlow / PyTorch:

これらはAIモデル開発のデファクトスタンダードとも言えるフレームワークです。GoogleやMeta(Facebook)が開発を主導しており、豊富なドキュメント、チュートリアル、コミュニティが存在します。まずは公式のチュートリアルから、画像分類の基本的なモデル構築を試してみるのが良いでしょう。 - データセットとアノテーション:

カスタムモデルを開発する上で最も重要になるのが、質の高いデータセットと正確なアノテーション(ラベル付け)です。公開されているデータセット(ImageNet, COCOなど)から始めるか、独自のデータ収集・アノテーションツールを活用する方法を検討しましょう。

まとめ: AI視覚検索が拓く未来

AIが視覚情報を理解する能力は、もはやSFの世界の話ではありません。Web制作の現場ではコンテンツ管理の自動化やUX向上に、AI開発の現場では新しいサービスやソリューションを生み出す核となる技術として、すでに実用段階に入っています。

この技術を理解し、活用することで、あなたのプロジェクトは次のレベルへと飛躍するでしょう。今日ご紹介したAPIやツール、学習ステップを参考に、ぜひ一歩踏み出してみてください。AI視覚検索の力は、単なる検索ツールに留まらず、Webサイトやアプリケーションの体験を根本から変え、新たな価値を創造する無限の可能性を秘めています。さあ、あなたの手で未来を切り拓きましょう!