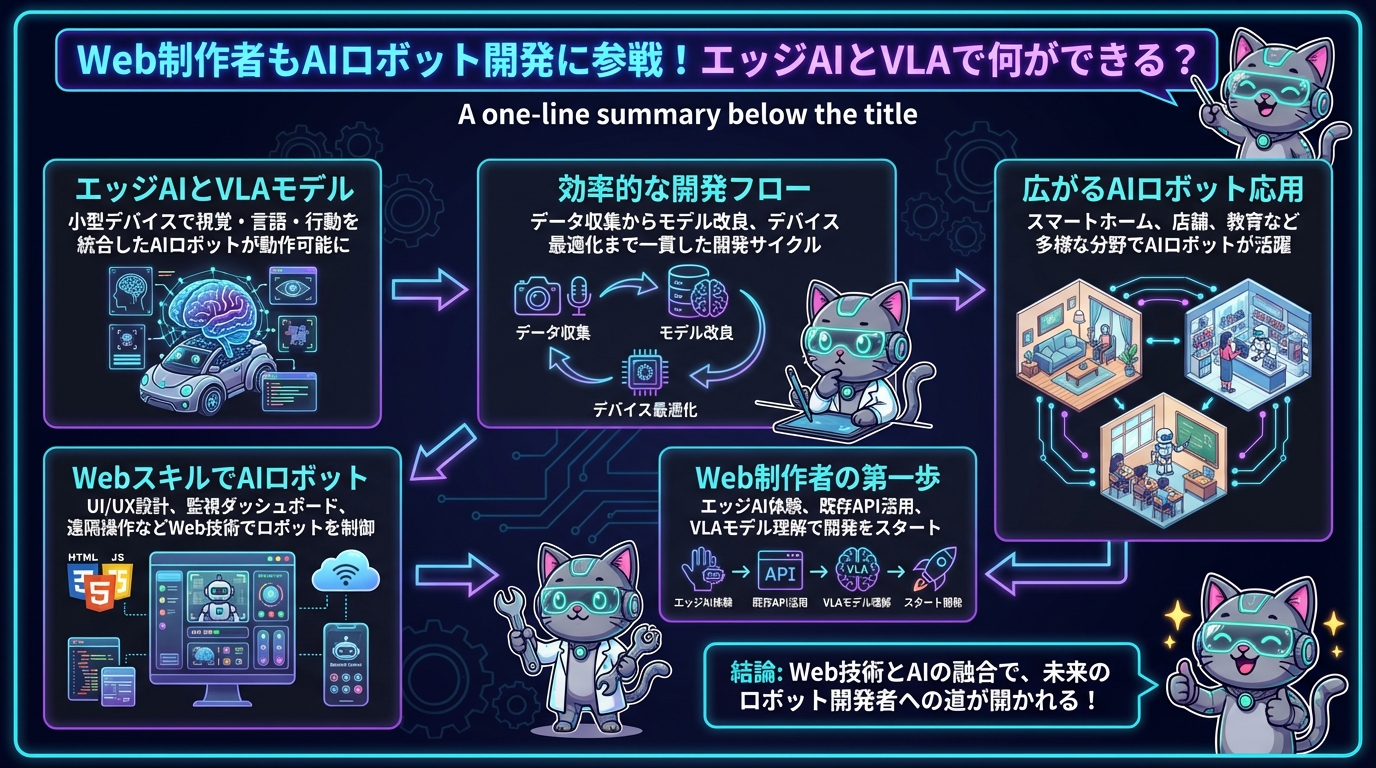

Web制作者もAIロボット開発に参戦!エッジAIとVLAで何ができる?

Web制作者もAIロボット開発に参戦!エッジAIとVLAで何ができる?

皆さん、こんにちは!Web制作とAI開発の最前線を追いかけるエンジニアの皆さん、お元気ですか?「AIロボット」と聞くと、SFの世界や専門的な研究機関の話だと思ってはいませんか?実は、Web制作者の皆さんのスキルが活かせる、新しいフロンティアが目の前に広がっているんです!

今回注目するのは、「Bringing Robotics AI to Embedded Platforms」という論文。

これは、ロボットAIを小型の組み込みプラットフォーム(いわゆるエッジデバイス)で動かす技術に焦点を当てたものです。具体的には、データセットの記録、VLA(Vision-Language-Action)モデルのファインチューニング、そしてオンデバイスでの最適化といった一連の流れが解説されています。

要するに、手のひらサイズのデバイスで動くロボットが、まるで人間のように「見て」「言葉を理解して」「行動する」AIを搭載できるようになる、という話です。これって、めちゃくちゃワクワクしませんか?

何ができるようになるのか?

この技術が実用化されると、以下のようなことが可能になります。

- 小型デバイス上で高度なAIロボットが動作: ラズベリーパイのような小型コンピュータでも、複雑なタスクをこなすAIを動かせるようになります。

- 視覚・言語・行動の統合(VLAモデル): ロボットがカメラで周囲を認識し、人間からの自然言語の指示を理解し、それに基づいて具体的な物理的行動を起こせるようになります。「テーブルの上の赤いカップを取って」といった指示に、ロボットが自律的に対応するイメージです。

- データ収集から最適化までの一貫した開発フロー: ロボットが実際に動作する環境でデータを収集し、そのデータを使ってAIモデルを改良し、さらに小型デバイス向けに最適化するという、効率的な開発サイクルが確立されます。

これまでは高性能なGPUサーバーが必要だったようなAI処理が、手の届くエッジデバイスで実現できるようになるわけです。これは、新しい製品やサービスの可能性を大きく広げます。

Web技術者のスキルを活かせる!具体的な応用例

「でも、それってロボットエンジニアの話でしょ?」と思ったあなた、ちょっと待ってください!Web制作者の皆さんのスキルは、この新しいAIロボットの世界で大いに役立ちます。

1. スマートホームデバイスの高度化

- 現状: スマートスピーカーは音声指示で家電を操作しますが、視覚的な情報までは考慮できません。

- 未来: VLAを搭載した小型ロボットが、部屋の状況をカメラで把握し、より複雑な指示に対応できます。

例:「散らかったリビングを片付けて」「冷蔵庫からビールを取ってきて」など。 - Web制作者の出番: ロボットのWebベースの監視ダッシュボード、遠隔操作インターフェース、AIモデルのカスタマイズ画面など、直感的で使いやすいUI/UXを設計・実装できます。JavaScriptでロボットのAPIを叩き、リアルタイムでフィードバックを受け取るシステムも開発可能です。

2. 店舗や倉庫での自動化・効率化

- 現状: 決められたルートを動く搬送ロボットや清掃ロボットが主流です。

- 未来: VLA搭載ロボットが、不特定多数の商品の中から特定の品物を見つけ出し、棚に並べたり、顧客の元へ運んだりできます。予期せぬ障害物にも柔軟に対応できます。

- Web制作者の出番: ロボット群のタスク管理システム、稼働状況のリアルタイムモニタリング、故障診断インターフェースなど、大規模なロボットフリートを管理するWebアプリケーションの構築が求められます。

3. 教育・エンターテイメント分野

- 現状: プログラミング学習用ロボットは、決められたコマンドで動くものがほとんどです。

- 未来: 自然言語で指示できる、よりインタラクティブな教育用ロボットや、ユーザーの言葉や行動に反応するペットロボットが登場します。

- Web制作者の出番: ロボットのプログラミングをブラウザ上で視覚的に行えるツール、ロボットとの対話を記録・分析するWebサービス、新しい行動パターンを簡単に共有できるコミュニティサイトなど、ユーザー体験を向上させるWebサービスの開発が不可欠です。

WebRTCを使ってロボットのカメラ映像をリアルタイムでWebブラウザにストリーミングしたり、WebSocketで双方向通信を行って、まるでゲームを操作するような感覚でロボットを制御したりすることも可能です。Web制作者の皆さんの得意分野が、そのままロボット開発の強力な武器になるのです。

いますぐ試すなら?Web制作者が始める第一歩

このエキサイティングな分野に飛び込んでみたい!そう思ったあなたのために、Web制作者が今すぐ始められるステップをいくつかご紹介します。

1. エッジAIの基礎を体験する

- ラズベリーパイやJetson Nanoなどのシングルボードコンピュータを手に入れてみましょう。

- TensorFlow LiteやPyTorch Mobileといったエッジデバイス向けのAIフレームワークをインストールし、簡単な画像認識や物体検出のサンプルコードを動かしてみます。カメラモジュールと組み合わせれば、身近なものを認識させるだけでも楽しいですよ。

- WebカメラとOpenCV.jsを組み合わせれば、ブラウザ上でリアルタイム画像処理を行うことも可能です。

2. 既存のAIモデルやAPIを触ってみる

- OpenAIのVision APIやHugging FaceのVision-Languageモデルなど、クラウドベースの強力なAIモデルをまずはAPI経由で試してみましょう。PythonやNode.jsでAPIを叩く経験は、将来的にロボットの制御にも役立ちます。

- ROS (Robot Operating System) の概念だけでも学んでおくと、ロボット開発の全体像を掴みやすくなります。ROSにはWebインターフェース(rosbridge_serverなど)もあるので、Webからロボットを操作する練習もできます。

3. VLAモデルの概念を理解する

- 今回の論文のようなVision-Language-Actionモデルに関する解説記事や研究論文を読んで、その仕組みや課題、可能性を理解しましょう。特に、データセットの収集やファインチューニングのプロセスは、AIモデルの性能を左右する重要な要素です。

Web制作者の皆さんは、API連携、UI/UX設計、クラウドとの連携、そしてユーザーフレンドリーなシステムの構築といったスキルをすでに持っています。これらは、AIロボットが社会に普及していく上で、「使いやすさ」という最も重要な要素を提供するために不可欠なスキルです。

AIロボットの「脳」を直接開発するわけではなくても、その「手足」や「インターフェース」、そして「社会との接点」を作るのが、Web制作者の皆さんの役割になるでしょう。動くWebサイトならぬ、「動くAIデバイス」をWeb技術で制御する日は、もうすぐそこまで来ています。ぜひ、この新しい波に乗って、あなたのスキルを未来のために活かしてください!