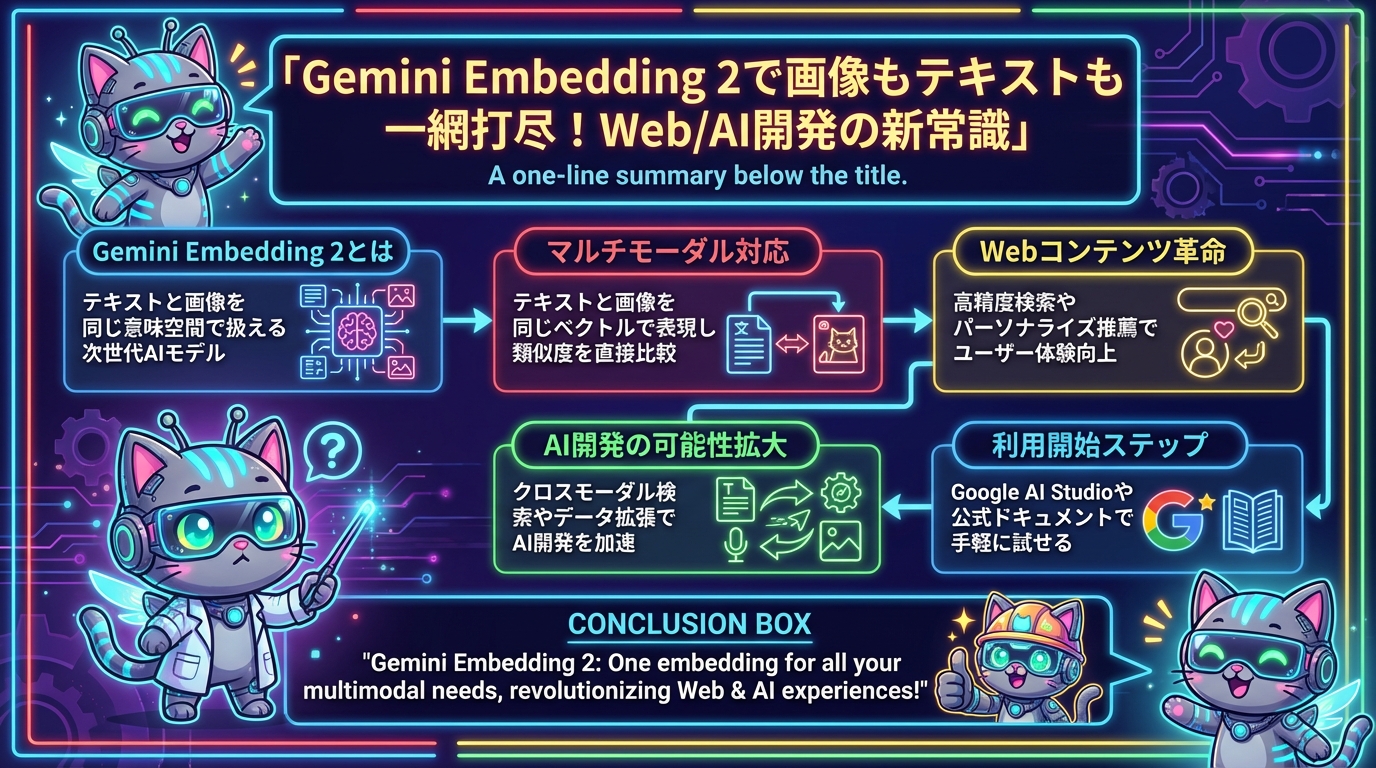

Gemini Embedding 2で画像もテキストも一網打尽!Web/AI開発の新常識

やっほー、みんな!Web制作もAI開発も、どんどん面白くなってるね!

Webの世界ではテキストと画像が主役だけど、これまでの検索やレコメンドって、テキストはテキスト、画像は画像で別々に扱われることが多かったと思わない?「この画像に似た文章を探したい」「この文章に合う画像を見つけたい」って思ったとき、ちょっと歯がゆい思いをした経験、きっとあるよね。

そんな悩みを吹き飛ばしてくれる、とんでもないツールがGoogleから登場したんだ!それが今回紹介する「Gemini Embedding 2」。これ、ただのエンベディングモデルじゃない。テキストと画像を「同じ土俵」で扱える、まさに次世代のマルチモーダルエンベディングモデルなんだ!

Gemini Embedding 2で「何ができる」のか、その核心に迫る!

Gemini Embedding 2の最大のポイントは、その名の通り「natively multimodal(ネイティブなマルチモーダル対応)」であること。これまでのモデルだと、テキストと画像を別々のエンベディングモデルで処理して、後から無理やり結合するみたいなアプローチが多かったんだ。でもGemini Embedding 2は違う!

- テキストと画像を「同じ意味空間」にマッピング: これが超重要!例えば「夕焼けのビーチ」というテキストと、実際に夕焼けのビーチの画像があったとするよね。Gemini Embedding 2は、これら二つの異なるモダリティ(テキストと画像)を、意味的に近い「ベクトル(数値の並び)」として表現できるんだ。つまり、テキストと画像の類似度を直接、高精度に比較できるようになるってこと!

- クロスモーダルな理解: テキストの内容から関連する画像を引っ張ってきたり、逆に画像の内容から関連するテキストを生成したり、検索したり。まるで人間が視覚情報と文字情報を同時に理解するように、AIもそれらを統合して扱えるようになるんだ。

- 多言語対応: もちろん、Googleのモデルだから多言語にも対応。日本語のテキストで英語の画像を検索する、なんてこともお手の物さ!

これって、まるでAIがテキストと画像を同時に、そしてシームレスに理解する「脳みそ」を手に入れたようなものだと思わない?開発者としてはワクワクが止まらないよね!

Web制作者・AI開発者は「どう使える」のか?具体的な活用例!

じゃあ、このGemini Embedding 2を僕たちの開発現場でどう活かせるのか、具体的なアイデアをいくつか紹介するよ!

Web制作の現場で革命を起こす!

- 超高精度なコンテンツ検索システム:

ユーザーが「カジュアルな夏のワンピースで、海辺を散歩している写真」と入力したら、それにピッタリの画像や、その画像が使われているブログ記事、さらには関連する商品ページまでを瞬時に探し出す!これまでのキーワード検索だけじゃ難しかった、より意味に基づいた検索が実現できるんだ。ECサイトの商品検索や、メディアサイトのコンテンツ検索が劇的に進化するよ。 - パーソナライズされたレコメンデーション:

ユーザーが特定の画像(例えば「猫がソファでくつろいでいる写真」)を閲覧したら、その画像と意味的に関連性の高い記事や別の画像、さらには猫グッズなどを推薦するシステムが作れる。ユーザーの行動データ(閲覧した画像やテキスト)から、潜在的な興味を深く掘り下げて最適なコンテンツを届けることができるんだ。 - アクセシビリティの向上と自動キャプション生成:

画像の内容を自動で理解し、適切なテキストキャプションを生成する基盤としても使える。これにより、視覚障がいのあるユーザーにもWebコンテンツがよりアクセスしやすくなるし、Webサイト運営側もaltテキストの作成コストを削減できる。 - UI/UXの改善:

画像とテキストの関連性を高めることで、ユーザーが求める情報に素早くたどり着けるようになる。例えば、画像をアップロードするだけで、その画像に合うテンプレートやテーマを提案するWebサイトビルダーなんてのも夢じゃない!

AI開発の現場で可能性を広げる!

- 究極のクロスモーダル検索エンジン:

テキストクエリで画像を検索したり、画像クエリでテキストドキュメントを検索したり、画像と画像を比較したり。これまで別々に処理していたものを統合することで、より柔軟でパワフルな検索システムを構築できる。セマンティック検索のマルチモーダル版だね! - データ拡張とアノテーション支援:

大量の画像データとテキストデータがあるときに、それらの関連性を自動で発見し、ペアリングを支援する。特に教師データが少ない分野で、半自動的にアノテーションを進めるのに役立つよ。 - コンテンツモデレーションの強化:

不適切な画像とテキストの組み合わせ(例えば、無害な画像でも、文脈によっては不適切になる場合)を検出する精度が向上する。WebサイトやSNSの健全性を保つ上で、非常に重要な機能だ。 - 少量のデータでの学習(Few-shot/Zero-shot Learning):

Gemini Embedding 2で得られた高次元のエンベディングを活用することで、特定のタスクにおいて、少量の教師データや全く教師データがない状態でも高い性能を発揮するモデルを構築できる可能性が広がる。

どう?これを聞いたら「よし、何か作ってみよう!」ってウズウズしてこない?

さあ、試すならどこから始める?

「よし、やってみよう!」と思ったキミに、まずはどこから手をつければいいか教えるね。

- Google AI Studio / Vertex AIをチェック!

Gemini Embedding 2は、GoogleのAI開発プラットフォームであるGoogle AI StudioやVertex AIを通じて提供されているよ。まずはこれらのプラットフォームにアクセスして、Geminiモデル群の中にEmbedding 2があるか確認してみよう。 - 公式ドキュメントを読み漁る!

Googleは非常に充実したドキュメントを提供しているから、まずは公式のガイドやAPIリファレンスをじっくり読むのが一番の近道。Python SDKやREST APIでの利用方法が詳しく解説されているはずだ。 - サンプルコードを動かしてみる!

「百聞は一見にしかず」って言うでしょ?Googleが提供しているサンプルコードやチュートリアルを実際に動かしてみて、テキストや画像をエンベディングする感覚を掴んでみよう。簡単なテキストと画像のペアで、類似度を計算してみるだけでも、そのパワフルさが実感できるはずだ。 - 簡単なPoC(概念実証)から始める!

いきなり大規模なシステムを構築するのではなく、まずは小さなPoCから始めるのがおすすめ。例えば、手持ちの画像データと説明文を使って、簡易的なクロスモーダル検索ツールを作ってみるとか。そこから徐々に機能を拡張していくと、成功体験を積みながら開発を進められるよ。

新しい技術に触れるって、本当に楽しいよね!Gemini Embedding 2は、Webコンテンツのあり方やAIアプリケーションの可能性を大きく広げてくれる、まさにゲームチェンジャーだ。キミのアイデアとこの強力なツールで、WebとAIの世界をもっと面白く、もっと便利にしていこう!

さあ、開発の準備はできたかい?Go for it!