爆速AI!Gemini 3.1 Flash-Liteの「Thinking Levels」が開発を変える

ついに登場!Gemini 3.1 Flash-Liteと「Thinking Levels」でAI開発が新次元へ

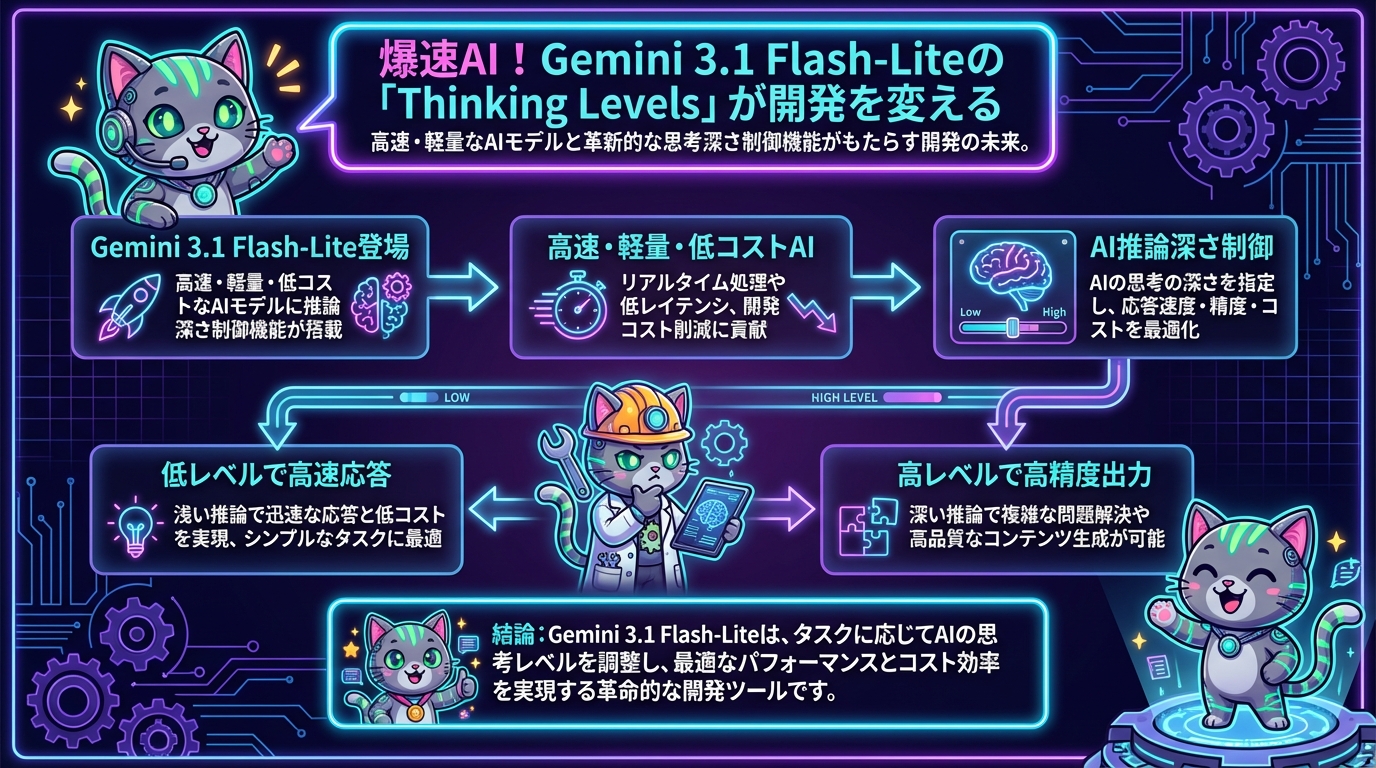

皆さん、こんにちは!Web制作とAI開発の最前線を駆け巡るエンジニアの皆さん、今日のニュースは要チェックですよ!GoogleがGemini 3.1 Flash-Liteをリリースしました。そして、このモデルには「Thinking Levels(推論の深さ制御)」という、開発者の皆さんにとって非常に強力な機能が搭載されています。

「Flash-Lite」という名前が示す通り、このモデルは高速性、軽量性、そしてコスト効率に優れています。しかし、何よりも注目すべきは、AIの「思考」の深さを私たち開発者がコントロールできるようになった点です。これにより、アプリケーションの応答速度、精度、そしてコストのバランスを、これまで以上に柔軟に調整できるようになります。まるでAIの脳みそに直接アクセスして、どれくらい深く考えるかを指示できるようなもの。これはもう、AI開発のゲームチェンジャーと言っても過言ではありませんね!

何ができるのか?「Thinking Levels」でAIの思考を操る

まずは、このGemini 3.1 Flash-Liteと、その目玉機能である「Thinking Levels」が一体何をもたらすのかを掘り下げていきましょう。

Gemini 3.1 Flash-Liteの基本

- 高速性&軽量性: 「Flash」という名の通り、非常に高速な応答が可能です。大量のプロンプトを捌くリアルタイム処理や、低レイテンシが求められるアプリケーションに最適です。

- コスト効率: 「Lite」の通り、リソース消費が抑えられ、コスト効率も抜群。開発コストを抑えつつ、AIの恩恵を最大限に享受できます。

- Gemini 3.1シリーズの恩恵: Gemini 3.1の強力なマルチモーダル能力やコンテキストウィンドウの広さといった基本的な機能はそのまま引き継いでいます。

「Thinking Levels」の核心:AIの推論を制御する

そして本題の「Thinking Levels」。これは、AIモデルがプロンプトに対してどれくらいの「深さ」で思考し、推論を行うかを開発者が指定できる画期的な機能です。具体的な数値(例えば0から1の範囲)で設定し、その値によってAIの振る舞いが変わります。

- 低いThinking Level(例: 0.1〜0.3):

AIはより浅い推論を行います。結果として、非常に迅速な応答が得られ、コストも低く抑えられます。シンプルな質問応答、定型的なタスク、高速なドラフト生成などに適しています。まるで「パッと直感で答えて!」と指示するようなイメージです。 - 高いThinking Level(例: 0.7〜0.9):

AIはより深い推論を行います。複雑な問題解決、複数の情報源からの統合、高度な分析、創造的なコンテンツ生成など、高い精度や質の出力が求められるタスクに威力を発揮します。応答速度はやや落ちますが、その分、質の高い、より「考え抜かれた」結果が得られます。これは「じっくり考えて、最善の答えを出して!」と依頼するようなものです。

この機能により、私たちはアプリケーションの要件に応じて、応答速度、精度、そしてコストという三つの要素を最適化できるようになります。これはプロンプトエンジニアリングの新たな地平を切り開くものと言えるでしょう。

どう使えるのか?Web制作・AI開発での具体的な活用例

さて、この強力な「Thinking Levels」を、私たちWeb制作者やAI開発者はどのように活用できるのでしょうか?具体的なユースケースをいくつか考えてみましょう。

1. Webサイトのリアルタイムチャットボット

- 初期応答の高速化: ユーザーがチャットボットに話しかけた際、最初の挨拶や簡単なFAQへの応答は

thinking_level=0.2のような低い値で設定。これにより、ユーザーは待つことなく、即座に反応を得られ、ストレスフリーな体験を提供できます。 - 複雑な問題解決へのエスカレーション: ユーザーの質問が複雑になり、より詳細な情報や推論が必要になった場合、内部的に

thinking_level=0.7などに切り替えて、より深い推論を行わせます。これにより、ユーザーはスムーズに問題を解決でき、同時にコストも無駄に消費しません。

2. コンテンツ生成・要約ツール

- ブログ記事のアイデア出しやドラフト生成: 大量の情報から素早くアイデアを抽出したり、記事の骨子を生成する際は

thinking_level=0.4で効率的に。 - SEOキーワード分析や高度な要約: 記事の品質を高めるためのSEOキーワード選定や、複雑なドキュメントの高度な要約には

thinking_level=0.8を設定。これにより、より深く文脈を理解し、精度の高い結果を生成できます。 - 複数品質コンテンツの自動生成: ターゲット層やプラットフォームに応じて、品質レベルの異なるコンテンツを自動で生成するシステムを構築することも可能です。

3. バックエンドAPIの最適化

- 大量データ処理でのコスト効率化: 顧客レビューの感情分析や、ログデータの要約など、大量のデータを高速かつコスト効率良く処理したい場合は

thinking_level=0.3で大まかな傾向を把握。 - クリティカルな意思決定支援: 金融取引の異常検知、医療診断支援など、高い精度と信頼性が求められるAPIでは

thinking_level=0.9に設定。リスクを最小限に抑えつつ、正確な判断をサポートします。

4. AIアシスタントやエージェント

- ユーザーの意図に応じた柔軟な対応: シンプルなコマンド実行や情報検索には低いレベルで即座に反応。ユーザーが複雑なタスク(例: 「来週の出張計画を立てて」)を指示した場合は、高いレベルに切り替えて、計画立案や情報収集を深く行わせる。

- 自律エージェントの行動最適化: AIエージェントが簡単な判断を素早く下す必要がある場面では低いレベル、戦略的な思考や計画が必要な場面では高いレベルを適用することで、より賢く、効率的な行動を実現できます。

試すならどこから始めるか?実践への第一歩

「よし、これは試してみるしかない!」そう思われた方も多いのではないでしょうか?では、具体的にどこから始めれば良いかをご紹介します。

1. Google AI Studio / Vertex AI

Gemini 3.1 Flash-Liteは、GoogleのAI開発プラットフォームであるGoogle AI StudioやVertex AIを通じて提供されます。まずはこれらのプラットフォームにアクセスし、APIキーを取得するところから始めましょう。

- Google AI Studio: プロトタイピングや小規模なプロジェクトに最適です。直感的なUIでモデルの動作を試すことができます。

- Vertex AI: より大規模な本番環境での利用や、高度なカスタマイズが必要な場合に適しています。

公式ドキュメントには、モデルの利用方法やAPIの仕様が詳しく記載されていますので、必ず目を通してくださいね。

2. Python SDK/クライアントライブラリで実践

実際にコードを書いてみるのが一番の近道です。GeminiモデルのPython SDKや各種クライアントライブラリを使えば、簡単にAPIを呼び出すことができます。

例えば、Pythonの場合、以下のような形でthinking_levelパラメータを渡すことになるでしょう(具体的なAPI仕様は公式ドキュメントで確認してください)。

import google.generativeai as genai

genai.configure(api_key=\"YOUR_API_KEY\")

model = genai.GenerativeModel('gemini-3.1-flash-lite')

# thinking_levelを0.3に設定して素早い応答を得る

response_fast = model.generate_content(\"日本の首都は?\

やってみよう

Gemini 3.1 Flash-LiteのThinking Levelsを実際に体験してみましょう。まずはGoogle AI Studioにアクセスして、新しいプロジェクトを作成します。モデル選択で「Gemini 3.1 Flash-Lite」を選び、プロンプトの最初にthinking_levelパラメータを追加するだけで、AIの思考の深さをコントロールできます。レベル1(高速・簡潔)からレベル5(深い推論・詳細)まで設定可能で、用途に応じて使い分けることで、応答速度とコストを最適化できます。

import google.generativeai as genai

# APIキーを設定

genai.configure(api_key="YOUR_API_KEY")

# Flash-Liteモデルを初期化

model = genai.GenerativeModel('gemini-3.1-flash-lite')

# Thinking Level 1で高速応答

response = model.generate_content(

"thinking_level: 1\n\nPythonでFizzBuzzを実装してください",

generation_config=genai.types.GenerationConfig(

temperature=0.7,

)

)

print(response.text)

🛠 作ってみよう: Thinking Levels対応チャットボット

⏱ 所要時間: 約30分 | 🟡中級

前提条件

Google AI Studio APIキーの取得

Python 3.8以上がインストール済み

基本的なPythonとStreamlitの知識

完成イメージ

Thinking Levelsをリアルタイムで切り替えながら、同じ質問に対するAIの応答の違いを比較できるWebアプリケーションを作成します。レベル1では瞬時に簡潔な回答を、レベル5では時間をかけて詳細な分析結果を表示します。

Step 1: 環境準備とライブラリインストール

必要なライブラリをインストールし、基本的なStreamlitアプリの骨組みを作成します。

pip install streamlit google-generativeai pandas plotly

# thinking_chat.py

import streamlit as st

import google.generativeai as genai

import time

import pandas as pd

import plotly.express as px

# ページ設定

st.set_page_config(

page_title="Thinking Levels Chat",

page_icon="🧠",

layout="wide"

)

st.title("🧠 Gemini Flash-Lite Thinking Levels デモ")

st.markdown("**AIの思考レベルを調整して、応答速度と詳細度のバランスを体験しよう!**")

Step 2: チャット機能とThinking Levels制御の実装

APIキー入力、思考レベル選択、チャット履歴管理機能を実装します。

# APIキー入力

api_key = st.sidebar.text_input("Google AI Studio APIキー", type="password")

if api_key:

genai.configure(api_key=api_key)

model = genai.GenerativeModel('gemini-3.1-flash-lite')

# Thinking Level選択

thinking_level = st.sidebar.selectbox(

"🎚️ Thinking Level",

options=[1, 2, 3, 4, 5],

index=2,

help="1: 超高速・簡潔 → 5: 深い推論・詳細"

)

# レベル説明

level_descriptions = {

1: "⚡ 超高速レスポンス(簡潔な回答)",

2: "🚀 高速レスポンス(基本的な説明付き)",

3: "⚖️ バランス型(適度な詳細)",

4: "🔍 詳細分析(深い考察)",

5: "🧠 最深思考(包括的な分析)"

}

st.sidebar.info(f"**選択中**: {level_descriptions[thinking_level]}")

# チャット履歴初期化

if "messages" not in st.session_state:

st.session_state.messages = []

if "response_times" not in st.session_state:

st.session_state.response_times = []

Step 3: レスポンス比較機能と分析ダッシュボード

同じ質問を異なるThinking Levelで処理し、応答時間と内容の違いを可視化します。

# メインチャットエリア

col1, col2 = st.columns([2, 1])

with col1:

# チャット履歴表示

for message in st.session_state.messages:

with st.chat_message(message["role"]):

st.markdown(message["content"])

if "response_time" in message:

st.caption(f"応答時間: {message['response_time']:.2f}秒 | Level: {message['level']}")

# ユーザー入力

if prompt := st.chat_input("質問を入力してください..."):

# ユーザーメッセージを追加

st.session_state.messages.append({"role": "user", "content": prompt})

with st.chat_message("user"):

st.markdown(prompt)

# AI応答生成

with st.chat_message("assistant"):

start_time = time.time()

# Thinking Levelを含むプロンプト作成

full_prompt = f"thinking_level: {thinking_level}\n\n{prompt}"

try:

response = model.generate_content(

full_prompt,

generation_config=genai.types.GenerationConfig(

temperature=0.7,

max_output_tokens=2048,

)

)

response_time = time.time() - start_time

st.markdown(response.text)

st.caption(f"応答時間: {response_time:.2f}秒 | Level: {thinking_level}")

# 履歴に追加

st.session_state.messages.append({

"role": "assistant",

"content": response.text,

"response_time": response_time,

"level": thinking_level

})

# 応答時間データを記録

st.session_state.response_times.append({

"level": thinking_level,

"time": response_time,

"length": len(response.text)

})

except Exception as e:

st.error(f"エラーが発生しました: {str(e)}")

with col2:

st.subheader("📊 パフォーマンス分析")

if st.session_state.response_times:

df = pd.DataFrame(st.session_state.response_times)

# 応答時間グラフ

fig_time = px.scatter(df, x="level", y="time",

title="Thinking Level別 応答時間",

labels={"level": "Thinking Level", "time": "応答時間(秒)"})

st.plotly_chart(fig_time, use_container_width=True)

# 文字数グラフ

fig_length = px.scatter(df, x="level", y="length",

title="Thinking Level別 応答文字数",

labels={"level": "Thinking Level", "length": "文字数"})

st.plotly_chart(fig_length, use_container_width=True)

# 統計表示

st.subheader("📈 統計情報")

stats = df.groupby("level").agg({

"time": ["mean", "min", "max"],

"length": ["mean", "min", "max"]

}).round(2)

st.dataframe(stats)

# 比較テスト機能

st.subheader("⚡ 一括比較テスト")

test_prompt = st.text_input("比較用プロンプト", "Pythonの基本的な使い方を教えて")

if st.button("全レベルで比較実行"):

if test_prompt:

results = []

progress_bar = st.progress(0)

for level in range(1, 6):

start_time = time.time()

full_prompt = f"thinking_level: {level}\n\n{test_prompt}"

try:

response = model.generate_content(full_prompt)

response_time = time.time() - start_time

results.append({

"Level": level,

"応答時間": f"{response_time:.2f}秒",

"文字数": len(response.text),

"応答": response.text[:100] + "..." if len(response.text) > 100 else response.text

})

except Exception as e:

results.append({

"Level": level,

"応答時間": "エラー",

"文字数": 0,

"応答": f"エラー: {str(e)}"

})

progress_bar.progress((level) / 5)

st.dataframe(pd.DataFrame(results))

else:

st.warning("👈 サイドバーでGoogle AI Studio APIキーを入力してください")

st.markdown("""

### 🚀 使い方

1. [Google AI Studio](https://aistudio.google.com/)でAPIキーを取得

2. 左サイドバーにAPIキーを入力

3. Thinking Levelを選択(1-5)

4. チャットを開始して違いを体験!

""")

カスタマイズのヒント

プロンプトテンプレート機能: よく使う質問パターンをプリセットとして保存し、ワンクリックで異なるレベルでテストできる機能を追加

応答品質評価: 各レベルの応答に対してユーザーが5段階で評価できる機能を実装し、レベル別の満足度を可視化

コスト計算機能: 各Thinking Levelの推定コストを表示し、予算に応じた最適なレベル選択をサポートする機能を追加