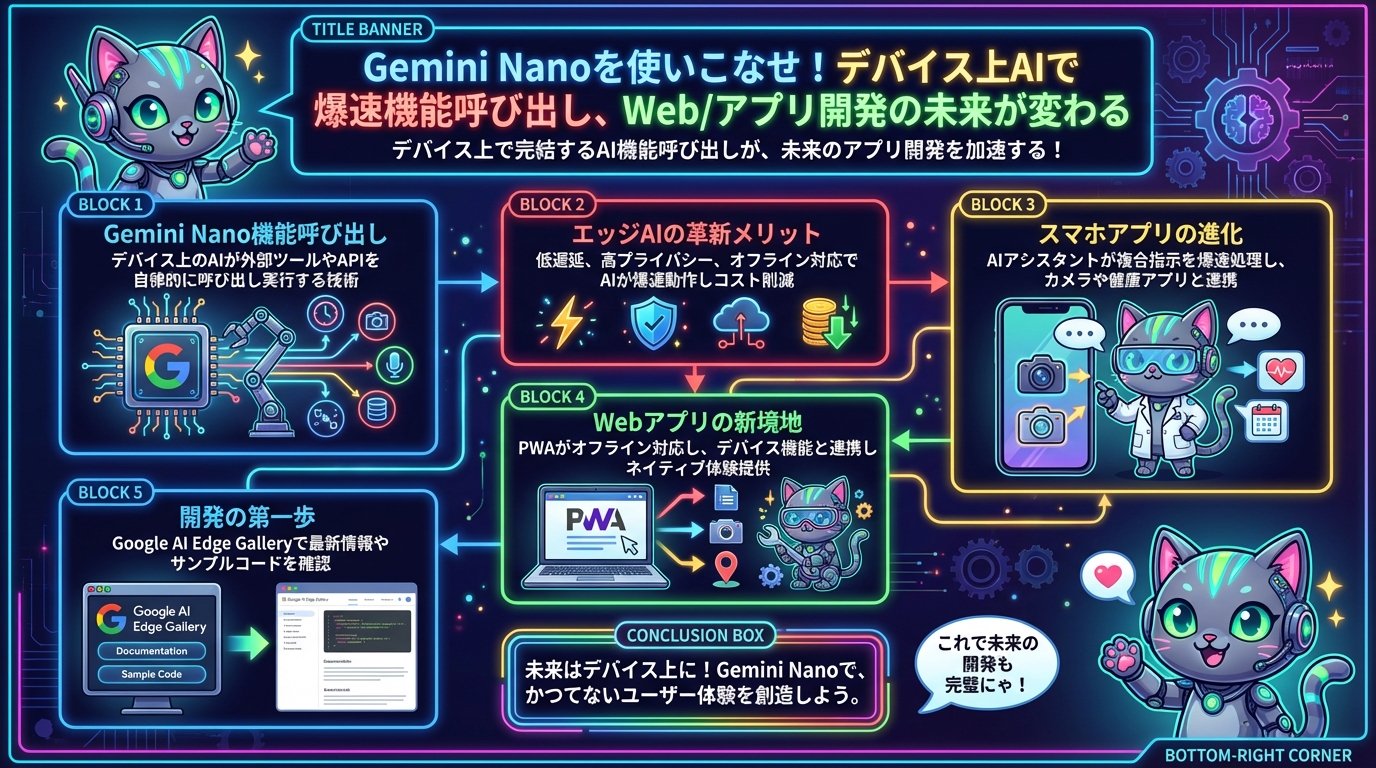

Gemini Nanoを使いこなせ!デバイス上AIで爆速機能呼び出し、Web/アプリ開発の未来が変わる

皆さん、こんにちは!Web制作とAI開発の最前線を追いかけるエンジニアブロガーです。今回は、Googleが発表したとんでもない技術「On-Device Function Calling in Google AI Edge Gallery」について、開発者やWeb制作者の皆さんが「これ、絶対使える!」とワクワクするような切り口で深掘りしていきます。

最近、AIの進化が目覚ましいですよね。特に大規模言語モデル(LLM)は、私たちの仕事や生活に大きな変革をもたらしつつあります。しかし、クラウドベースのAIには、レイテンシ(応答速度の遅さ)、通信コスト、そして何よりもプライバシーの問題が常に付きまとっていました。そこで注目されているのが「エッジAI」、つまりデバイス上でAIを動かす技術です。そして、GoogleがこのエッジAIの可能性をさらに広げる「On-Device Function Calling」を発表したんです。これは、まさにゲームチェンジャーですよ!

特に、皆さんのスマホにも搭載され始めているGoogleの小型AIモデル「Gemini Nano」が、デバイス上で外部のツールやAPIを直接呼び出せるようになる、という話を聞いたら、もう興奮が止まらないはず!さあ、この革新的な機能が一体何をもたらすのか、具体的にどう使えるのか、そしてどうやって試せるのか、一緒に見ていきましょう!

何ができるのか?:デバイスAIが「自分で考えて」行動する未来

「On-Device Function Calling」とは、簡単に言えば、デバイス上で動作するAIモデル(例えばGemini Nano)が、ユーザーの指示や状況に応じて、デバイス内の機能や外部のAPI(ツール)を自律的に呼び出し、実行できるようになることです。これまでのAIは、テキスト生成や画像認識など「推論」がメインでしたが、この機能はAIに「行動」の選択肢を与えるものです。

具体的に何がすごいのか、ポイントをまとめてみました。

- 爆速応答(低レイテンシ): クラウドとの通信が不要になるため、処理がデバイス内で完結し、瞬時の応答が可能になります。ユーザー体験が劇的に向上します。

- プライバシーの強化: ユーザーの個人データがデバイス外に出ることなく処理されるため、プライバシー保護の観点から非常に優れています。機密性の高い情報も安心して扱えます。

- オフラインでの動作: ネットワーク接続がない環境でも、AIが機能呼び出しを実行できます。山奥でも、飛行機の中でも、あなたのAIアシスタントは働き続けます。

- コスト削減: クラウドAPIの利用料金を削減できます。特に大規模なアプリケーションでは、運用コストに大きな差が出ます。

- AIの汎用性向上: AIモデル自身の知識だけでなく、デバイスが持つセンサーデータや、Web上の最新情報(API経由)と連携することで、より賢く、より実用的なタスクをこなせるようになります。

Web制作者の皆さんにとっては、PWA(Progressive Web Apps)やWebAssembly(Wasm)と組み合わせることで、ブラウザ上で動作するWebアプリが、まるでネイティブアプリのようにデバイスの機能に深くアクセスし、オフラインでも賢く動作する未来が見えてくるはずです。これは、単なる「Webサイト」の枠を超えた体験を提供できる可能性を秘めています。

どう使えるのか?:Web/アプリ開発の具体例

このOn-Device Function Callingは、私たちの想像力を掻き立てる無限の可能性を秘めています。いくつか具体的なユースケースを考えてみましょう。

スマートフォンアプリ開発の革命

- パーソナルAIアシスタントの進化

「明日の朝7時にアラームをセットして、今日の天気と交通状況を教えて」といった複合的な指示に対し、AIがデバイス内のアラーム機能、天気予報API、地図APIをそれぞれ呼び出し、実行。全てデバイス内で完結するため、爆速で応答します。 - カメラアプリの賢い機能拡張

「この写真に写っている料理のレシピを検索して、買い物リストに追加して」と指示すると、AIが画像認識で料理を特定し、WebのレシピAPIを呼び出してレシピを取得、さらにデバイス内の買い物リストアプリに連携。 - 健康・フィットネスアプリの最適化

ユーザーの心拍数や活動量データをデバイス上でリアルタイム解析し、「今日の運動量なら、〇〇の栄養素を多く含む食事をおすすめします」と提案。さらにデバイス内の食事記録アプリに自動で記録する、といった連携も可能に。

Webアプリ/PWA開発の新境地

- オフライン対応のEコマースサイト

ユーザーがオフライン状態でも、AIがローカルにキャッシュされた商品データや過去の購入履歴を分析し、「前回購入した〇〇と相性の良い新商品が入荷しました」と提案。オンラインになった瞬間に、おすすめ商品をサーバーと同期する。 - ローカルデータ活用型CRM/SaaS

営業担当者がオフラインの状況で顧客情報(デバイス内のローカルデータ)を更新し、AIがその情報に基づいて次のアポイントメントを提案。さらに、デバイス内のカレンダーアプリに自動で登録。 - IoTデバイス連携Web UI

スマートホームのWebコントロールパネルから、「リビングの照明を映画モードにして」と指示すると、Webアプリがデバイス内のAIを介して、直接リビングのスマート照明デバイスのAPIを呼び出し、クラウドを介さずに高速で設定変更。プライバシーも向上します。 - ブラウザ内での高度な画像・動画編集

WebAssemblyで高速化された画像・動画処理機能と連携し、「この動画から不要な部分を自動でカットして、BGMを付けて」とAIに指示。AIが動画解析を行い、WebAssemblyの機能を呼び出して編集、全てブラウザ内で処理を完結させます。

AI開発者にとってのメリット

- モデルの汎用性と能力の拡張

特定のタスクに特化したAIモデルでも、Function Callingを通じて外部ツールと連携することで、その能力を大幅に拡張できます。例えば、言語モデルが計算ツールを呼び出して正確な計算結果を返したり、最新の株価情報を取得したり。 - エッジデバイスでの複雑なワークフロー実現

これまでクラウドでしか実現できなかったような、複数のステップを伴う複雑なAIワークフローを、低スペックなエッジデバイス上でも実現できるようになります。

試すならどこから始めるか?

さて、ここまで読んで「よし、試してみよう!」と思ったあなたのために、最初の一歩を踏み出すためのヒントをお伝えします。

Googleは「Google AI Edge Gallery」という場所で、On-Device Function Callingを含むエッジAIの最新情報やサンプルコードを提供しています。ここがあなたのスタート地点となるでしょう。

- Google AI Edge Galleryをチェック

まずは、Google AI Edge Galleryの公式サイトを訪れてみてください。デモやユースケースの紹介、そして開発者向けのドキュメントやサンプルコードが公開されています。特に、Function Callingに関する具体的な実装例は必見です。 - Gemini Nano SDK/APIに触れる

Androidアプリ開発者であれば、Gemini Nanoを利用するためのSDKやAPIが提供されています。これを使って、実際にデバイス上でGemini Nanoを動かし、簡単なFunction Callingを実装してみるのが良いでしょう。公式ドキュメントには、ステップバイステップのガイドが用意されているはずです。 - MediaPipeを活用する(Web制作者向け)

Web制作者の皆さんにとっては、Googleのオープンソースフレームワーク「MediaPipe」が強力なツールとなります。MediaPipeは、Webブラウザ上で機械学習モデルを動かすためのライブラリで、Gemini Nanoのような軽量モデルとの連携も期待できます。MediaPipeとWebAssemblyを組み合わせることで、ブラウザ内でAIがデバイスの機能やWeb APIを呼び出すようなプロトタイプを構築できるかもしれません。 - 簡単なツール関数を定義してみる

まずは、非常にシンプルなツール関数(例えば、特定のテキストを読み上げる機能や、デバイスの明るさを変更する機能など)を定義し、それをAIモデルから呼び出す練習をしてみましょう。Googleのドキュメントには、そのような基本的な実装例が必ず含まれています。

この技術はまだ進化の途上にありますが、そのポテンシャルは計り知れません。デバイス上でのAIの自律的な機能呼び出しは、私たちの作るWebサービスやアプリケーションに、これまでにない価値と体験をもたらすことでしょう。ぜひ、一歩踏み出して、この新しい可能性を探索してみてください。未来のWeb/アプリは、あなたの手にかかっています!