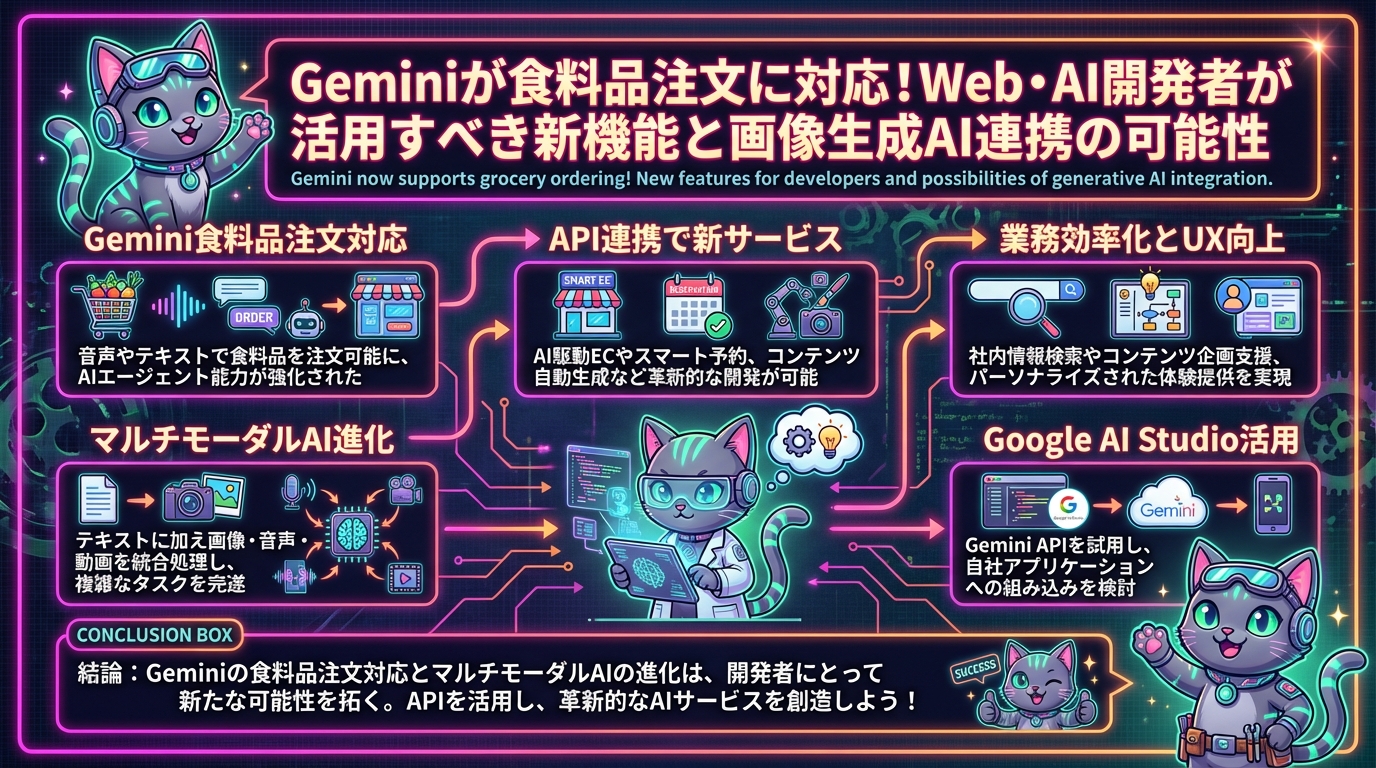

Geminiが食料品注文に対応!Web・AI開発者が活用すべき新機能と画像生成AI連携の可能性

皆さん、こんにちは!Web制作とAI開発の最前線を追いかけるエンジニアブロガーの〇〇です。

いやー、GoogleのAI進化、止まりませんね!先日発表された最新のPixelアップデート、皆さんもうチェックしましたか?特に注目すべきは、AIアシスタントGeminiが「食料品を注文できる」ようになったというニュースです。

「え、それってただの便利機能でしょ?」と思ったそこのあなた!ちょっと待ってください。これは単なる個人の利便性向上にとどまらず、Web制作やAI開発の現場に大きなインパクトを与える可能性を秘めているんです。

今日の記事では、このGeminiの新機能が一体何で、私たち開発者・Web制作者がどう活用できるのか、そしてどこから試すべきかまで、深掘りしていきます。特に「画像生成AI」というカテゴリにも触れつつ、マルチモーダルAIとしてのGeminiのポテンシャルを探っていきましょう!

Geminiで何ができるようになったのか?

今回のPixelアップデートで、Geminiはさらに賢く、そして実用的に進化しました。最も話題になっているのが、「食料品注文」のサポートです。具体的には、音声コマンドやテキスト入力で「今週の夕食の材料を注文して」とGeminiに指示するだけで、提携しているスーパーマーケットのアプリ(Instacartなど)と連携し、買い物リスト作成から注文までをサポートしてくれます。これは、ユーザーの文脈を理解し、複数のアプリを横断してタスクを実行できる、まさに「AIエージェント」としての能力が強化されたことを意味します。

- 複雑なマルチステップタスクの実行: 食料品注文だけでなく、旅行の計画、イベントのチケット手配など、複数の手順が必要なタスクをAIが代行できるようになります。

- デバイス上の情報との連携: Pixelデバイス内の写真や動画、メールなどの個人情報と連携し、よりパーソナライズされたアシスタント体験を提供します。例えば、「この写真の材料で何が作れるか教えて」と聞けば、レシピを提案し、さらに必要な材料を注文する、といった流れも可能になります。

- リアルタイムの状況認識: 位置情報やカレンダー情報と連携し、ユーザーの行動やニーズを先読みした提案ができるようになります。

これは、単なる音声アシスタントの域を超え、ユーザーの意図を深く理解し、自律的に行動するAIの姿を示しています。特に注目すべきは、「マルチモーダルAI」としてのGeminiの真骨頂です。テキストだけでなく、画像、音声、動画といった様々な形式の情報を処理し、それらを統合してタスクを完遂する能力が、今回のアップデートでさらに磨かれたと言えるでしょう。

Web制作・AI開発者はどう活用できるのか?

このGeminiの進化は、私たち開発者にとってまさに宝の山です。「ユーザーが何を求めているのか」をより深く理解し、それを実現するための強力なツールが手に入った、と考えることができます。

1. API連携による革新的なサービス開発

- AI駆動型ECサイトの実現:

ユーザーが「週末のパーティー用のワインとチーズをいくつか提案して、予算は5000円くらいで」と入力するだけで、GeminiがECサイトの商品データベースから最適な商品をピックアップし、カートに追加する。さらに、そのパーティーの雰囲気に合わせた画像生成AIによるイメージ画像を動的に表示し、購買意欲を高める、といった体験が考えられます。

将来的には、ユーザーの過去の購入履歴や嗜好をGeminiが学習し、さらにパーソナライズされた提案や、定期購入の自動化なども可能になるでしょう。 - スマートな予約・マッチングシステム:

「来月、家族で温泉旅行に行きたいんだけど、子供が遊べる施設があって、料理が美味しい宿をいくつか探して」といった複雑な条件でも、Geminiが複数の予約サイトやレビューサイトを横断的に検索し、最適なプランを提案。さらに、その宿の魅力を伝えるために、画像生成AIで生成したイメージ画像を添えることで、視覚的な訴求力を高めることができます。 - コンテンツ生成・編集の自動化:

Webサイトの記事作成やSNS投稿において、Geminiがキーワードや文脈を解析し、適切な文章を生成。さらに、その文章の内容に合わせた画像を画像生成AIに指示して生成し、記事に挿入する、といったワークフローが実現できます。これにより、コンテンツ制作のリードタイムを大幅に短縮し、クリエイターはより創造的な作業に集中できるようになります。 - 次世代の顧客サポートAI:

既存のチャットボットでは難しかった、ユーザーの複雑な質問や要求(例:「先日購入した商品の返品について、注文番号は〇〇で、理由は〜」)に対しても、Geminiが文脈を理解し、適切な情報を提供したり、返品プロセスを自動で開始したりできるようになります。さらに、ユーザーの感情を分析し、より人間らしい応対をすることも可能になるでしょう。

2. 業務効率化ツールとしての利用

- 社内情報検索・要約の高度化:

膨大な社内ドキュメントや会議議事録から、必要な情報を瞬時に探し出し、要約する。例えば、「〇〇プロジェクトの最新の進捗状況を、過去3ヶ月のデータと比較してレポートして」といった複雑な指示にも対応できるようになります。 - Webサイトのコンテンツプランニング支援:

SEOキーワード分析から、ユーザーの検索意図に合わせたコンテンツ構成案の自動生成、さらにはそのコンテンツに最適な画像を画像生成AIで提案・生成するなど、企画段階でのAI活用が進みます。 - プロトタイピングとアイデア出し:

新しいWebサービスやアプリのアイデアをGeminiに投げかけ、ユーザーシナリオや機能要件の壁打ち相手になってもらう。これにより、開発初期段階での手戻りを減らし、より洗練されたプロダクト開発が可能になります。

3. ユーザー体験(UX)の劇的な向上

- パーソナライズされたWebサービスの提供:

ユーザーの行動履歴、好み、デバイス上の情報などをGeminiが統合的に分析し、一人ひとりに最適化されたWebコンテンツや機能を提供する。例えば、特定のユーザーには食料品の割引情報、別のユーザーには旅行の特別プラン、といった具合に、AIが個別のニーズを先読みして情報提供できるようになります。 - 音声UI/UXの設計:

音声コマンドだけでWebサイトの操作や情報検索ができるようになれば、キーボードやマウスを使わない、より直感的でアクセシブルなWeb体験が実現します。Geminiの自然言語理解能力とタスク実行能力を活かし、音声だけで完結するサービス設計が重要になってきます。

まずはどこから試してみる?

「よし、Geminiのポテンシャルは分かった!でも、どこから手をつければいいんだ?」と思った開発者の皆さん、ご安心ください。いくつかのアプローチがあります。

- Google AI StudioとGemini APIをチェック:

最も手っ取り早いのは、Google AI StudioでGeminiの機能を実際に触ってみることです。ここからGemini APIのドキュメントにアクセスし、どのように自分のアプリケーションに組み込めるのか、具体的なコード例を見ながら検討しましょう。

特に、関数呼び出し(Function Calling)の機能は要注目です。これにより、Geminiが外部ツール(例:ECサイトのAPI、画像生成AIのAPI)を呼び出し、タスクを完了させることが可能になります。まさに、今回の食料品注文のような機能を実現する鍵となる部分です。 - Pixelデバイスで実体験:

もしPixel 8 Proなどの最新Pixelデバイスをお持ちであれば、実際に「食料品を注文して」と話しかけてみましょう。ユーザーとして体験することで、AIアシスタントの進化の度合いや、今後どのようなUXが求められるのか、肌で感じることができます。 - 既存プロジェクトへの応用アイデアをブレインストーミング:

現在関わっているWebサイトやAIプロジェクトに、Geminiの新しい機能をどう組み込めるか、チームでアイデア出しをしてみましょう。「この部分はAIに任せられるのでは?」「ユーザーはこんなことをAIにやってほしいんじゃないか?」といった視点で議論することで、新たなビジネスチャンスが見えてくるかもしれません。 - 画像生成AIとの連携PoC(概念実証):

カテゴリが画像生成AIであることから、特にこの領域での連携を考えてみましょう。Geminiに「このWebサイトの記事に合うような、未来都市の風景画像を生成して」と指示し、Geminiがその指示を画像生成AIに渡し、結果をWebサイトに埋め込む、といったPoCは非常に面白い試みになるはずです。マルチモーダルな入力と出力を意識した開発を進めることで、よりリッチなユーザー体験を提供できるでしょう。

Geminiの進化は、私たちWeb制作・AI開発者にとって、新たなサービスやプロダクトを生み出す大きなチャンスです。単なる「便利機能」で終わらせるのではなく、その裏にあるAIの技術的進化と、それがもたらすビジネスインパクトを深く理解し、いち早く自分の開発に取り入れていくことが、これからの時代を生き抜く鍵となるでしょう。

さあ、皆さんもGeminiの最新機能を試して、未来のWeb・AIサービスを一緒に創造していきましょう!