google

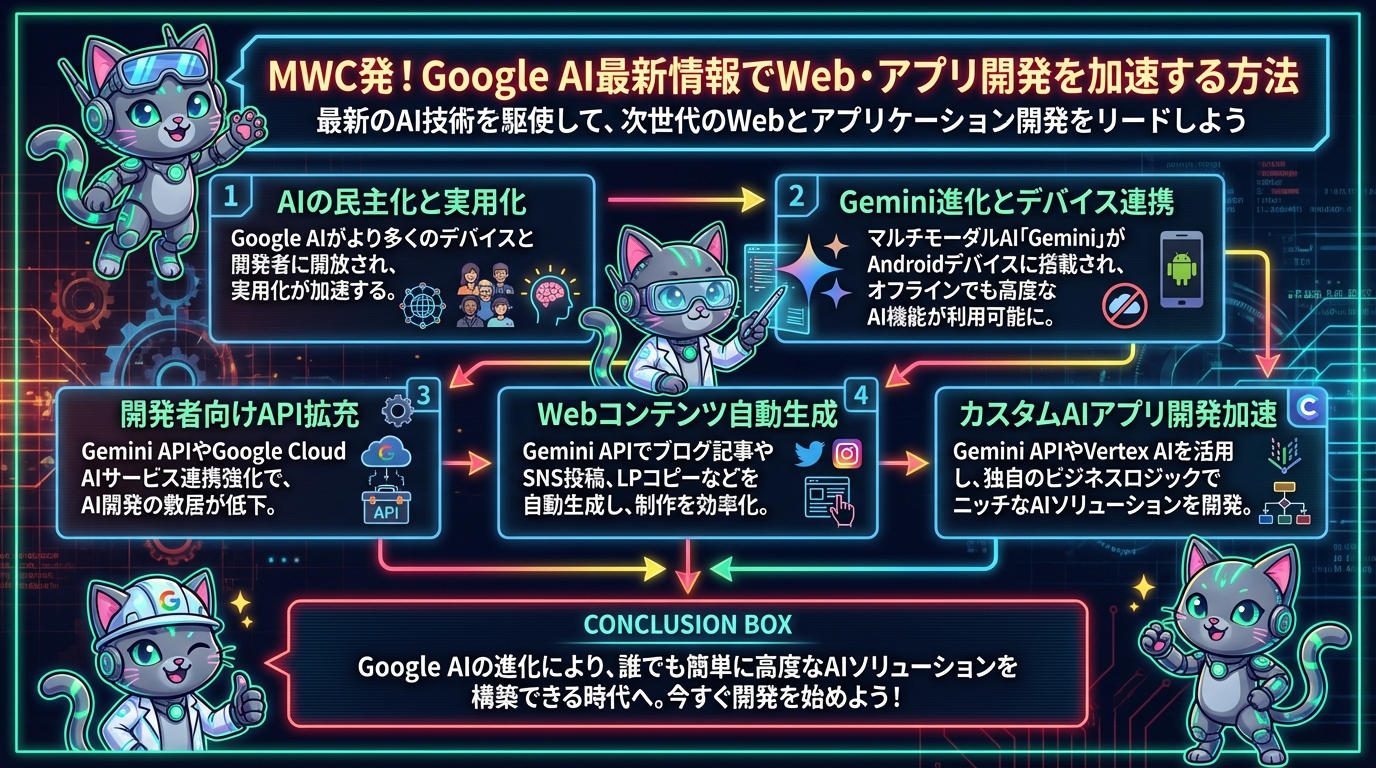

MWC発!Google AI最新情報でWeb・アプリ開発を加速する方法

23分で読める

MWCでGoogle AIが魅せた未来!開発者なら見逃し厳禁!

皆さん、こんにちは!WebとAIの世界を行き来する、プロのエンジニアブロガーです。先日スペイン・バルセロナで開催されたモバイル業界最大のイベント、MWC (Mobile World Congress) 2024、チェックしましたか?

GoogleがAndroidとGoogle AIに関する最新情報をドドンと発表し、我々開発者の心を躍らせるアップデートが盛りだくさんでした。特にAIの進化は目覚ましく、「これ、うちのプロジェクトで使えるんじゃね?」ってニヤニヤが止まらないレベル。今回は、MWCで発表されたGoogle AIの最新情報の中から、Web制作者やAI開発者が「これ使えそう!」「試してみよう」と思える実用的なポイントを深掘りしていきます!

MWCで発表されたGoogle AIの「何ができる」のか?

今回のMWCでのGoogle AIの発表は、一言で言えば「AIの民主化と実用化の加速」に尽きます。特に印象的だったのは以下の点です。

- Geminiのさらなる進化とデバイス連携の強化:

Googleが誇るマルチモーダルAI「Gemini」が、より多くのAndroidデバイスに搭載され、OSレベルでの連携が深まっています。これにより、デバイス上での処理能力が向上し、オフラインでも高度なAI機能が利用可能になる道が開かれました。例えば、スマートフォンのカメラで撮影した写真から即座に情報を抽出したり、手書きのメモをデジタル化したりといったことが、よりスムーズに、より高精度で実現できるようになります。 - 開発者向けAPIとツールの拡充:

Gemini APIの進化はもちろん、Google CloudのAIサービス(Vertex AIなど)との連携も強化されています。これにより、開発者はより簡単に、そして効率的にGoogleの最先端AIモデルを自身のアプリケーションやサービスに組み込めるようになりました。特に、ノーコード・ローコード開発ツールとの連携も進んでおり、AI開発の敷居がグッと下がっています。 - パーソナライゼーションとユーザーエクスペリエンスの向上:

AIがユーザーの行動パターンや好みをより深く学習し、それぞれのユーザーに最適化された情報や機能を提供する能力が飛躍的に向上しています。これは、Android OS全体だけでなく、Webサービスやアプリケーションにおいても、よりリッチでパーソナルな体験を提供するための基盤となります。 - 画像・動画生成AIの活用範囲拡大:

テキストから画像を生成するだけでなく、動画コンテンツの自動生成や編集支援、さらにはリアルタイムでのAR/VR体験へのAI統合など、クリエイティブな分野でのAI活用が加速しています。

Web制作・AI開発者は「どう使える」のか?具体的な活用例

さて、これらの最新技術を我々開発者がどう具体的に活用できるのか、いくつか具体的なシナリオを考えてみましょう。

Web制作者向けの活用術

- コンテンツ制作の自動化・効率化:

Gemini APIを活用して、ブログ記事の草稿、SNS投稿のキャプション、WebサイトのLPコピーなどを自動生成できます。キーワードやトピックを与えるだけで、SEOに強いコンテンツのアイデア出しから具体的な文章作成までをAIがサポート。もちろん最終的な人間によるチェックは必須ですが、大幅な時間短縮になります。例: ユーザーの検索意図に合わせたタイトル案を複数生成し、その中から最適なものを選んで本文の骨子を作成。 - パーソナライズされたUI/UXの実現:

ユーザーの閲覧履歴や行動パターンをAIが分析し、Webサイトのコンテンツやレイアウトを動的に変更。例えば、ECサイトでユーザーの好みに合わせた商品レコメンデーションをリアルタイムで行ったり、ニュースサイトで関心のある記事を上位表示させたりすることで、エンゲージメントを高められます。 - 画像・動画コンテンツの自動生成・最適化:

Webサイトのヘッダー画像、ブログ記事の挿絵、SNS広告用のバナーなどを、テキストプロンプトからAIで生成。また、既存の画像をAIで最適化(サイズ調整、圧縮、背景除去など)することで、Webサイトの表示速度向上にも貢献します。 - 高度なチャットボット・カスタマーサポート:

Geminiの理解力と生成能力を活かし、より自然で人間らしい会話が可能なチャットボットをWebサイトに導入。FAQ応答だけでなく、ユーザーの問い合わせ内容から最適なソリューションを提案したり、過去の購買履歴に基づいてパーソナライズされたサポートを提供したりできます。

AI開発者向けの活用術

- カスタムAIアプリケーション開発の加速:

Gemini APIを直接利用し、独自のビジネスロジックやデータと組み合わせることで、汎用的なAIサービスでは実現できないニッチなソリューションを開発できます。例えば、特定の業界に特化した情報解析ツールや、企業内のナレッジベース検索システムなどです。 - モバイルデバイス向けAI機能の実装:

Android OSとの連携強化により、スマートフォンやタブレット上で動作する軽量かつ高性能なAIモデルを開発・デプロイしやすくなります。オフラインでの画像認識、音声コマンド処理、ARアプリケーションなど、デバイス上でのリアルタイム処理が求められるシーンでの活用が期待されます。 - Vertex AIを使った効率的なモデル管理:

Vertex AIの機能拡張により、モデルのトレーニングからデプロイ、監視までの一連のライフサイクルをより効率的に管理できるようになります。AutoML機能を使えば、機械学習の専門知識がなくても、特定のタスクに特化したカスタムモデルを素早く作成できます。 - マルチモーダルAIの新たな応用:

テキスト、画像、音声、動画といった複数のモダリティを同時に処理できるGeminiの能力を活かし、例えば、動画コンテンツの内容を自動で要約したり、製品のレビュー画像から顧客の感情を分析したりと、これまでにないAI体験を創出できます。

今すぐ「試すなら」どこから始める?

「よし、やってみよう!」と思ったあなたに、Google AIの最新機能を体験するためのファーストステップをいくつかご紹介します。

- Google AI Studio と Gemini API を触ってみる:

最も手軽にGeminiの能力を体験できるのが、Google AI Studioです。Webブラウザから無料でアクセスでき、プロンプトエンジニアリングの基本から、Gemini APIを使った簡単なアプリケーション構築まで試せます。まずはここで、Geminiがどんなことができるのか、そのポテンシャルを感じてみてください。 - Google DevelopersブログやGoogle Cloudブログをチェック:

最新の技術情報や開発者向けチュートリアルが定期的に公開されています。MWCの発表に関する詳細な技術解説や、具体的なコード例などもここでキャッチアップできます。特に、公式ドキュメントは必読です。 - Vertex AIの無料枠を活用してみる:

Google CloudのVertex AIには、無料枠が用意されています。これを利用して、AutoMLやカスタムトレーニングの基本的な流れを体験してみるのがおすすめです。大規模なAIモデルの運用を学ぶ良い機会になります。 - GitHubのサンプルコードを探す:

Googleは多くのAI関連プロジェクトのサンプルコードをGitHubで公開しています。「Google AI samples」などで検索すると、Gemini APIを使った様々なアプリケーション例が見つかります。既存のコードをフォークして、自分なりにカスタマイズしてみるのも良い学習方法です。 - Google Developer Groups (GDG) に参加する:

世界各地で開催されているGDGは、Googleテクノロジーに関心のある開発者のコミュニティです。勉強会やハッカソンに参加することで、最新情報を得られるだけでなく、他の開発者との交流を通じて新たなアイデアやヒントを得られるかもしれません。

MWC 2024で発表されたGoogle AIの進化は、Web制作やAI開発の現場に大きな変革をもたらす可能性を秘めています。新しい技術をいち早くキャッチアップし、自身のスキルセットに取り入れることで、未来のプロジェクトをリードする存在になれるはずです。さあ、あなたも今日からGoogle AIの最前線に飛び込んでみませんか?