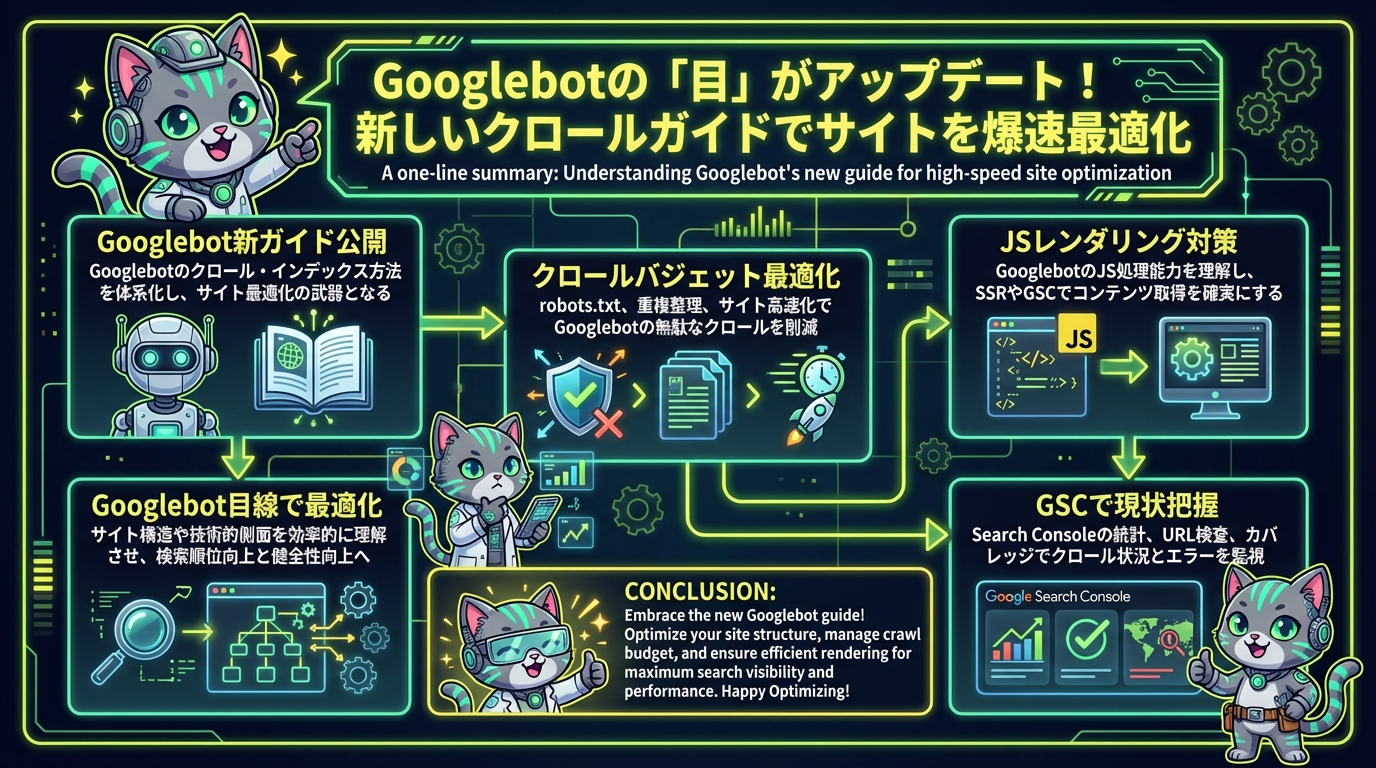

Googlebotの「目」がアップデート!新しいクロールガイドでサイトを爆速最適化

Googlebotの「目」を理解する!新ヘルプドキュメントの衝撃

どうも!Web制作とAI開発の狭間で日々奮闘しているエンジニアブロガーです。今回は、Web制作者や開発者の皆さんにとって超重要なニュースをお届けします。

なんと、GoogleがWebクローリングに関する新しいヘルプドキュメントを公開しました!これは、Googlebotが私たちのサイトをどのように発見し、クロールし、そしてインデックスするかについての公式かつ最新の見解がまとめられたものなんです。

これまでも断片的に情報は公開されていましたが、今回のドキュメントはそれらを体系的に整理し、より詳細な情報が提供されています。これを知ることは、あなたのサイトがGoogle検索で適切に評価されるための最強の武器になると断言できます。

新しいドキュメントは、単に「Googlebotがこう動くよ」という説明に留まりません。サイトのパフォーマンスがクロールに与える影響、JavaScriptの処理方法、そしてクロールバジェットの概念など、開発者が直接的に関わるテクニカルSEOの領域が深く掘り下げられています。

つまり、この新しい「Googlebotの目線」を理解することで、私たちはサイトの構造、コンテンツ、技術的側面をGooglebotにとって最も効率的かつ理解しやすい形に最適化できるわけです。これは、検索順位の向上だけでなく、サイト全体の健全性向上にも繋がります。

どう使えるのか?開発者・Web制作者のための実践的アプローチ

さて、具体的にこの新しいドキュメントをどう活用すれば良いのでしょうか?いくつか具体的なアプローチを紹介します。

1. クロールバジェットの最適化で「無駄」をなくす

- robots.txtの再確認: 新しいドキュメントでは、robots.txtの役割が改めて強調されています。不要なページ(管理画面、テスト環境、低品質なコンテンツなど)へのクロールをブロックし、重要なページにGooglebotのリソースを集中させましょう。ただし、インデックスさせたくないページをrobots.txtでブロックすると、Googleがそのページについて全く情報を得られなくなり、リンク評価も伝わらなくなる点には注意が必要です。noindexタグとの使い分けを理解しましょう。

- 重複コンテンツの整理: パラメータ違いのURLや、PC・モバイルで同じ内容のページがある場合、canonicalタグを適切に設定し、クロールバジェットの無駄遣いを防ぎましょう。

- サイト高速化: ページの読み込み速度が遅いと、Googlebotは限られた時間内でクロールできるページ数が減ってしまいます。画像最適化、CSS/JSのミニファイ、サーバー応答時間の改善など、サイトのパフォーマンス向上はクロール効率に直結します。

2. JavaScriptレンダリングの理解と対策

- GooglebotのJS処理能力: GooglebotはJavaScriptを実行し、ページをレンダリングします。しかし、全てのJSを完璧に処理できるわけではありません。新しいドキュメントでは、この処理プロセスがより明確にされています。SPA(Single Page Application)を構築している場合は、サーバーサイドレンダリング(SSR)やプリレンダリングを検討することで、Googlebotがコンテンツを確実に取得できるようにすることが重要です。

- Google Search Consoleでの確認: URL検査ツールを使って、Googlebotがどのようにページをレンダリングしているかを確認しましょう。期待通りにコンテンツが表示されているか、JSによって動的に生成されるコンテンツが正しく認識されているか、定期的にチェックすることが大切です。

3. 論理的なサイト構造と内部リンクの強化

- ユーザーフレンドリーな構造: Googlebotはユーザーと同じようにサイトを巡回します。ユーザーが目的のページにスムーズにたどり着けるような、論理的で階層的なサイト構造は、Googlebotのクロール効率も高めます。

- 適切な内部リンク: 関連性の高いページ同士を適切に内部リンクで繋ぐことで、Googlebotはサイト全体を効率的に発見し、各ページの重要性を理解しやすくなります。アンカーテキストも意識して記述しましょう。

- XMLサイトマップ: サイトマップは、Googlebotにサイト内の全ての重要なページの存在を知らせる「地図」です。常に最新の状態に保ち、Search Consoleから送信しましょう。

4. エラーとリダイレクトの適切な管理

- 4xx/5xxエラーの解消: 存在しないページ(404 Not Found)やサーバーエラー(500 Internal Server Error)が多発すると、Googlebotはサイトの品質が低いと判断し、クロール頻度を下げることがあります。Search Consoleでエラーを監視し、速やかに修正しましょう。

- 301リダイレクトの活用: ページのURLを変更した場合や、HTTPSへの移行時などには、恒久的な変更を示す301リダイレクトを適切に設定し、旧URLの評価を新URLに引き継ぎましょう。

試すならどこから始める?今日からできるファーストステップ

「よし、やってみよう!」と思ったあなた、素晴らしいです!では、どこから手をつければ良いでしょうか?

1. まずは公式ドキュメントを熟読する

何はともあれ、まずはGoogleが公開した新しいヘルプドキュメント自体を読んでみましょう。英語ですが、DeepLなどの翻訳ツールを使えば大意は掴めます。Googlebotの挙動に関する理解が深まるだけで、あなたのSEOに対する視点は大きく変わるはずです。

2. Google Search Consoleを徹底的に活用する

Search Consoleは、Googleとあなたのサイトを結ぶ強力なツールです。以下のレポートを重点的にチェックしてください。

- クロールの統計情報: Googlebotがあなたのサイトにどれくらいの頻度で、どれくらいのページをクロールしているかを確認できます。クロール頻度が低いと感じたら、改善の余地があるかもしれません。

- URL検査ツール: 特定のURLを入力し、「インデックス登録をリクエスト」するだけでなく、Googlebotがそのページをどのようにクロールし、レンダリングしているかを確認しましょう。特にJavaScriptを多用しているページでは、期待通りにコンテンツが取得されているか確認が必須です。

- カバレッジレポート: インデックスされているページ数、エラー、除外されているページなどが一目でわかります。エラーが発生している場合は、その原因を特定し、修正する最優先事項です。

3. 既存のrobots.txtとサイトマップを見直す

現在のrobots.txtファイルが、本当に意図した通りに機能しているか確認しましょう。不要なクロールをブロックしつつ、重要なページへのアクセスを妨げていないか、慎重にチェックが必要です。また、XMLサイトマップが最新の状態であり、Search Consoleに正しく登録されているかも確認しましょう。

4. サイトのパフォーマンスを計測し、改善計画を立てる

PageSpeed InsightsやLighthouseなどのツールを使って、サイトの速度やパフォーマンスを計測しましょう。特にモバイル環境での表示速度は重要です。改善点が見つかったら、具体的な計画を立てて実装に移しましょう。

5. JavaScriptのSEOフレンドリー化を意識する

もしあなたのサイトがJavaScriptを多用しているなら、Googlebotがコンテンツをスムーズに取得できるよう、以下の点を検討してください。

- 重要なコンテンツはHTMLの初期ロード時に利用可能にする。

- JavaScriptの遅延読み込みを適切に設定する。

- GoogleのモバイルフレンドリーテストやURL検査ツールで、JS実行後のページが正しくレンダリングされているか確認する。

今回のGoogleの新しいドキュメントは、単なる情報更新ではなく、Webサイトのインデックス状況を改善し、SEO効果を最大化するためのロードマップと言えます。知っているだけでは意味がありません。ぜひ、今日から一つずつでも実践して、あなたのサイトをGooglebotにとって最高の場所にしていきましょう!

それでは、また次の記事でお会いしましょう!