Jetson Orin Nanoで動く!Gemma 4 VLAが実現する自律型AIアシスタントの可能性

エッジデバイスで実現する、自律的な視覚言語AIアシスタント「Gemma 4 VLA」

皆さん、こんにちは!Web制作とAI開発の最前線を追いかけるエンジニアの皆さん、今回はエッジAIの驚くべき進化をご紹介します。NVIDIA Jetson Orin Nano Super上でGoogleの高性能AIモデル「Gemma 4 VLA」が動作するデモンストレーションが公開され、その自律的な振る舞いが大きな話題を呼んでいます。

「Gemma 4 VLA」の「VLA」は「Visual Language Assistant」の略。つまり、視覚情報と言語情報を統合して処理するAIアシスタントです。このデモの何がすごいかというと、AIがユーザーの質問内容を理解し、必要と判断すれば自らの意思でWebカメラを起動して視覚情報を取得、その情報を基に回答を生成するという、まるでSFのような体験をローカル環境で実現している点にあります。

従来のAIアシスタントのようにキーワードでカメラ起動をトリガーしたり、特定のロジックをハードコードしたりする必要はありません。Gemma 4 VLAは、質問の文脈から自律的に判断を下します。これはまさに、AIが「目を開き、状況を判断する」という新たなステップを踏み出したことを意味します。

Gemma 4 VLAができること:AIが「見て」「考えて」「答える」

このデモの核となる機能は、以下のシンプルな流れで構成されています。

- ユーザーが話す: 音声認識 (Parakeet STT) が音声をテキストに変換します。

- Gemma 4が思考: Gemma 4 VLAがテキストを分析し、回答を生成します。

- 必要ならWebカメラ起動: 質問が視覚情報を必要とすると判断した場合、Gemma 4が自律的にWebカメラを起動し、画像を撮影します。

- 視覚情報を活用して回答: 撮影した画像を「描写」するのではなく、その画像から得られるコンテキストを使って、ユーザーの元の質問に答えます。

- 音声で回答: テキストを音声合成 (Kokoro TTS) で音声に変換し、スピーカーから出力します。

この一連のプロセスが、わずか8GBのRAMを持つJetson Orin Nano Super上で、すべてローカルで完結するというのですから驚きです。エッジデバイスでの高性能AIの実行は、これまで想像もできなかったような可能性を秘めています。

開発者・Web制作者必見!Gemma 4 VLAが切り開く活用シーン

この自律型視覚言語AIアシスタントは、私たち開発者やWeb制作者にとって、非常に魅力的なツールとなるでしょう。具体的な活用例をいくつかご紹介します。

スマートホーム・オフィスアシスタントの進化

「冷蔵庫に何がある?」と聞けば、AIが自律的に冷蔵庫内を撮影し、中身を把握して教えてくれる。あるいは、「この部屋の電気を消して」と言えば、AIが部屋の状況を目視で確認し、最適なアクションを実行する。視覚情報を加えることで、より自然でインテリジェントなアシスタントが実現できます。

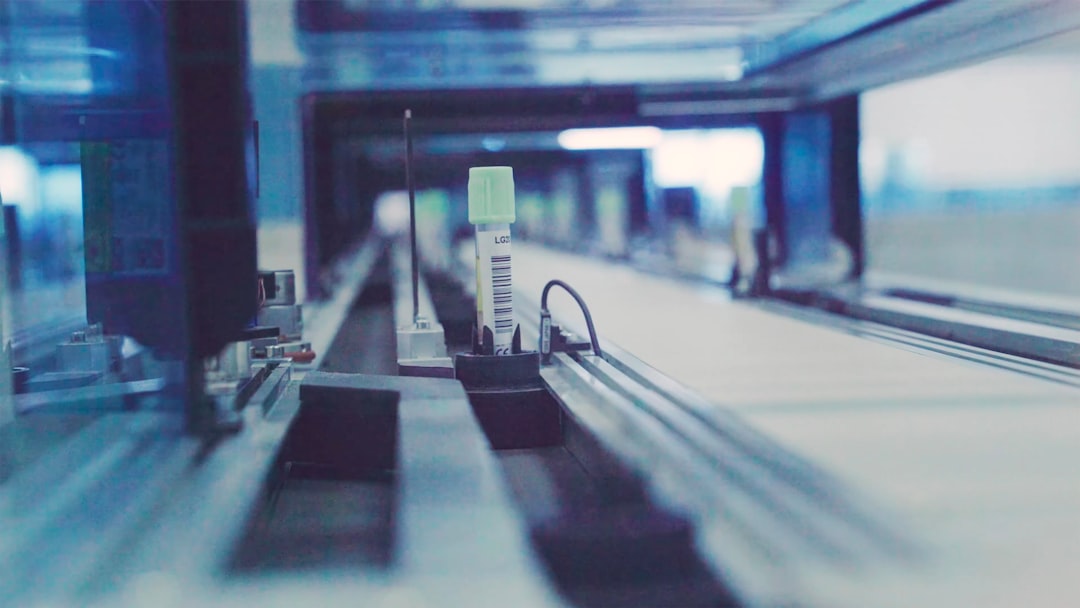

産業・製造現場での作業支援

製造ラインで異常が発生した際、AIがカメラで状況を認識し、適切な指示を出す。あるいは、熟練工の作業をAIが視覚的に学習し、新人作業員への指導に活用するといった応用も考えられます。目視検査の自動化も、より高度な判断力を伴って実現可能になるでしょう。

教育・学習支援ツール

子供が目の前の図鑑を指して「これは何?」と尋ねた際、AIが図鑑のページを認識し、その動物についての詳細な情報を音声で説明する。インタラクティブな学習体験を、よりパーソナルな形で提供できるようになります。

ロボティクス分野への応用

ロボットが周囲の環境を自律的に認識し、与えられたタスクを達成するための判断を下す。Gemma 4 VLAは、ロボットの「目」と「脳」を統合する強力な基盤となり得ます。例えば、障害物を認識して回避したり、特定のオブジェクトを見つけ出して操作したりする際に、人間のような柔軟な判断が可能になるかもしれません。

これらの事例はほんの一部です。AIが自律的に視覚情報を取得し、それを踏まえて質問に回答するという特性は、あらゆる「状況判断」が求められる場面で、私たちの想像力を掻き立てるはずです。

すぐに試せる!Gemma 4 VLAデモのセットアップ方法

この素晴らしいデモは、なんとGitHubでコードが公開されており、すぐに試すことができます。開発者の皆さん、これは見逃せません!

必要なハードウェア

- NVIDIA Jetson Orin Nano Super (8 GB): デモの核となるエッジAIデバイスです。

- Logitech C920 webcam: 内蔵マイク付き。Linuxで認識される一般的なWebカメラであれば代用可能です。

- USBスピーカー: Linuxで認識されるUSBスピーカーであれば代用可能です。

- USBキーボード: 音声録音の開始/停止にSPACEキーを使用します。

コードの入手

以下のいずれかの方法で、GitHubリポジトリからコードを入手できます。

git clone https://github.com/asierarranz/Google_Gemma.gitcd Google_Gemma/Gemma4

または

wget https://raw.githubusercontent.com/asierarranz/Google_Gemma/main/Gemma4/Gemma4_vla.py

必要なファイルはGemma4_vla.py一つだけです。STT/TTSモデルや音声アセットは、初回実行時にHugging Faceから自動的にダウンロードされます。

システムセットアップの概要

基本的なシステムパッケージのインストールから始めます。git、build-essential、cmake、python3-pip、alsa-utilsなど、開発に必要なツールやオーディオ・Webカメラ関連のパッケージをインストールします。

次に、Python仮想環境を構築し、必要なライブラリ(opencv-python-headless、onnx_asr、kokoro-onnxなど)をインストールします。

RAMの解放(推奨): Jetson Orin Nano Superの8GB RAMを最大限に活用するため、スワップファイルを追加することが推奨されています。これにより、モデルのロード時などに発生するメモリ不足(OOM)を防ぎ、よりスムーズな動作が期待できます。元記事では8GBのスワップファイル追加コマンドが紹介されています。

詳細はGitHubリポジトリ内のGemma4_vla.pyファイルや関連ドキュメントを確認してください。

まとめ:エッジAIの未来を、あなたの手で

Gemma 4 VLAとJetson Orin Nano Superの組み合わせは、エッジデバイスにおけるAIの可能性を大きく広げるものです。AIが自律的に周囲の環境を認識し、状況に応じて判断を下す能力は、私たちの生活やビジネスに革命をもたらすポテンシャルを秘めています。

「こんなに高性能なAIが、こんなに小さなデバイスで動くなんて!」と元記事の著者も驚きを隠せないほど。開発者の皆さん、この機会にぜひGemma 4 VLAを試して、エッジAIの最前線を体験し、あなたのアイデアを形にしてみてはいかがでしょうか。未来のAIアシスタントは、もう目の前に来ています。