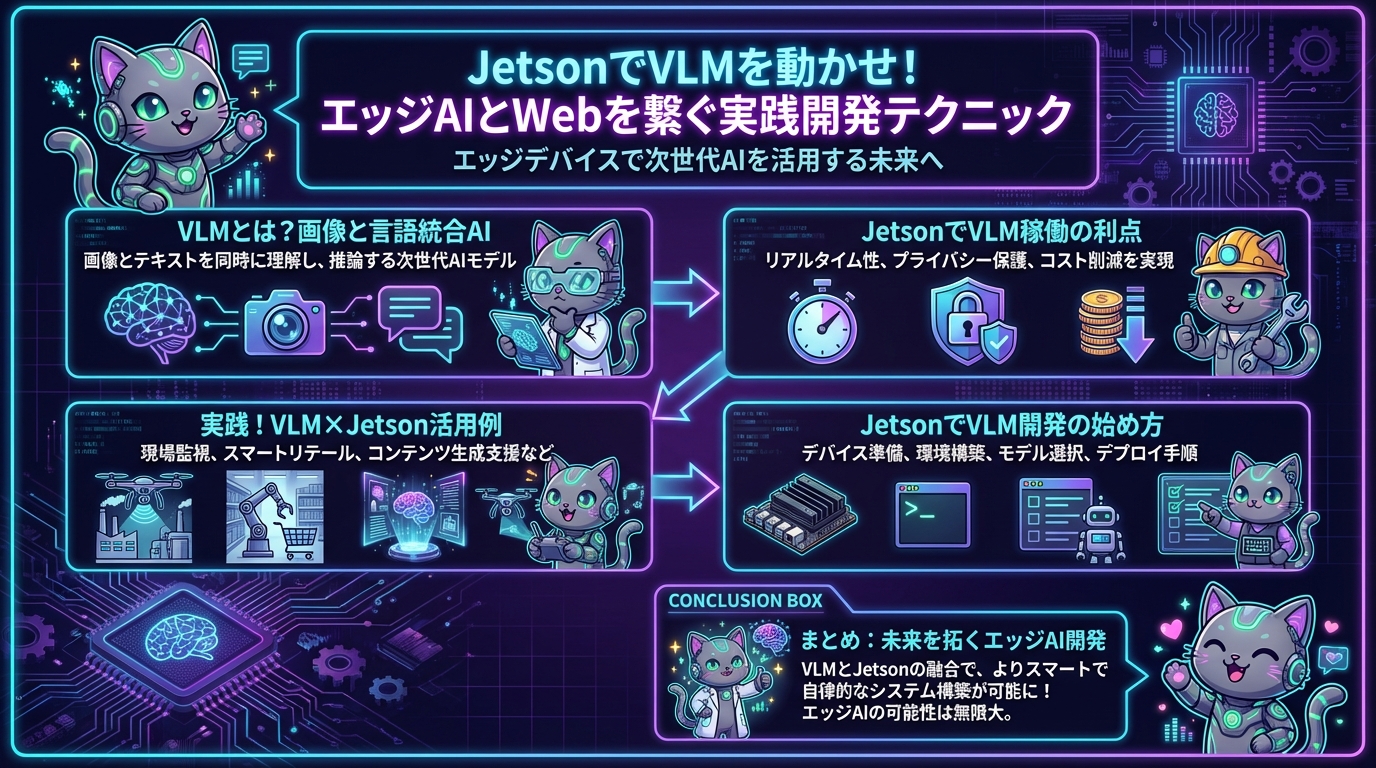

JetsonでVLMを動かせ!エッジAIとWebを繋ぐ実践開発テクニック

Web制作者・AI開発者必見!VLMとJetsonが拓く新しい世界

Web制作やAI開発に日々奮闘されている皆さん、こんにちは!最先端の技術を追いかける中で、「Vision Language Models (VLM)」という言葉を耳にすることが増えてきたのではないでしょうか?画像とテキストを同時に理解し、推論するその能力は、まさに次世代AIの主役候補。

そして、そのVLMをエッジデバイス、特にNVIDIA Jetson上で動かすという話。これを聞いて、「え、それって何に使えるの?」「Webサービスにどう活かせる?」とワクワクしたあなたのために、今回はVLMとJetsonの組み合わせがもたらす無限の可能性と、その実践的なアプローチについて深掘りしていきます。開発者の皆さんが「これ使えそう!」「よし、試してみよう!」と思えるような、具体的なヒントが満載ですよ!

VLMとは何か?なぜJetsonで動かすのか?

VLMは、その名の通り「Vision(視覚)」と「Language(言語)」を統合したAIモデルです。これまでのAIは、画像認識は画像認識、自然言語処理は自然言語処理と、それぞれ独立して進化してきました。しかしVLMは、例えば「この画像に何が写っていて、それはどういう状況なのか?」といった問いに対し、画像の内容を深く理解した上で、自然な言葉で説明したり、推論したりすることができます。これは単なる画像キャプション生成とは一線を画す、より高度な知能です。

では、なぜこの強力なVLMをNVIDIA Jetsonのようなエッジデバイスで動かす必要があるのでしょうか?その答えは、リアルタイム性、プライバシー、そしてコストにあります。

- リアルタイム性: クラウドにデータを送って処理する時間がない、即座の判断が求められる現場(工場、店舗、自動運転など)で威力を発揮します。

- プライバシー: センシティブな画像データなどをクラウドにアップロードせず、デバイス内で処理を完結できるため、セキュリティとプライバシー保護に貢献します。

- コスト: 大量のデータを常にクラウドに送り続ける必要がなくなり、通信コストやクラウド利用料を削減できます。

Jetsonは、コンパクトなサイズと低消費電力でありながら、GPUを搭載しているため、VLMのような計算負荷の高いモデルもエッジで高速に推論できるのが最大の魅力。WebサービスやIoTデバイスとの連携を考えれば、その実用性は計り知れません。

Web制作者・AI開発者が「これ使える!」具体例

VLMとJetsonの組み合わせが、私たちの開発現場にどのような変革をもたらすのか、具体的なユースケースを見ていきましょう。

- 現場監視・自動報告システム:

工場や建設現場に設置されたJetson搭載カメラが、異常(例: 作業員のヘルメット未着用、危険区域への侵入、機械の異常な動き)を画像で検知。VLMがその状況を「作業員がヘルメットを着用していません」とテキストで説明し、リアルタイムでWebダッシュボードやLINE、Slackなどのチャットツールに通知。手動での目視確認が不要になり、安全管理と効率が大幅に向上します。 - スマートリテール・顧客行動分析:

店舗に設置されたJetsonデバイスが、顧客の行動(例: 特定の商品を手に取った回数、滞留時間)を分析。VLMが「男性客が新商品のスニーカーを30秒間見ている」といった情報を抽出し、店員にパーソナライズされた接客を促したり、Webベースの在庫管理システムに連携して人気商品の補充を自動化したりできます。 - コンテンツ自動生成支援ツール:

WebサイトのCMSに画像をアップロードする際、Jetson上のVLMが画像を解析し、関連性の高いキャプション、タグ、代替テキスト(alt属性)を自動で提案。SEO対策やアクセシビリティ向上に貢献し、コンテンツ制作の効率を劇的に高めます。特にECサイトの商品画像や、ブログ記事の挿絵などで大きな効果が期待できます。 - リアルタイム翻訳・説明システム:

観光地や公共施設に設置し、カメラ映像に映る看板や注意書きをVLMが認識し、多言語でリアルタイムに説明を生成。Webアプリケーションを通じてスマートフォンに配信することで、外国人観光客の利便性を高めます。また、視覚障害者向けに、周囲の状況をVLMが音声で説明するアクセシビリティサービスも実現可能です。 - スマートホーム・IoT連携:

スマート冷蔵庫にJetsonとVLMを搭載。冷蔵庫内の画像をVLMが解析し、「牛乳が残り少ない」「卵が3個」といった情報をWebアプリでユーザーに通知。さらに、「牛乳が少ないので、スーパーの特売情報を検索しますか?」といった提案まで自動で行うことが可能になります。

これらの例はほんの一部です。VLMの「画像を見て言葉で説明する」能力は、Webサービスと連携することで、ユーザー体験を根本から変える可能性を秘めています。

VLM on Jetsonを試すなら、どこから始める?

「よし、試してみよう!」と思ったあなたのために、実践への第一歩を案内します。

1. Jetsonデバイスの準備:

まずはNVIDIA Jetsonデバイスを手に入れましょう。手軽に始めたいならJetson Nano、より高性能なモデルで本格的に開発するならJetson Orin Nano/NXなどがおすすめです。NVIDIAの公式ストアや、国内の販売代理店から購入できます。

2. 開発環境の構築:

Jetsonには、NVIDIAが提供する「JetPack SDK」を導入します。これには、CUDA、cuDNN、TensorRTなど、AI開発に必要なライブラリやツールが含まれています。特にTensorRTは、モデルの推論を高速化するために非常に重要です。Python環境(Anacondaやvenvなど)もセットアップしておきましょう。

3. オープンソースVLMモデルの選択:

幸いなことに、VLMの分野でも素晴らしいオープンソースモデルが多数公開されています。代表的なものとしては、以下のようなモデルが挙げられます。

- LLaVA (Large Language and Vision Assistant): 画像と指示テキストから、詳細な説明や対話を行うことができます。GitHubでモデルやコードが公開されており、Jetsonでの動作事例も増えています。

- Fuyu-8B: Databricksが開発した、高速な推論が可能なVLM。特定のタスクに特化しているため、Jetsonのようなエッジデバイスでの利用に適している場合があります。

- MiniGPT-4: GPT-4のような大規模言語モデルと視覚モデルを組み合わせたVLM。より複雑な推論や対話が可能です。

これらのモデルはHugging Face Hubなどで公開されており、PyTorchなどのフレームワークで簡単にロードして試すことができます。まずは、比較的小規模でJetsonでの動作実績があるモデルから始めるのがおすすめです。

4. デプロイとWeb連携のステップ:

- モデルのダウンロードと変換: 選択したVLMモデルをJetsonにダウンロードし、必要に応じてTensorRT形式に変換して推論を高速化します。

- 推論スクリプトの作成: Pythonを使って、VLMモデルをロードし、カメラからの入力画像(または静止画)とプロンプト(質問)を与えて、結果をテキストで受け取るスクリプトを作成します。

- Web APIの公開: 作成した推論スクリプトを、FlaskやFastAPIなどの軽量なWebフレームワークを使ってREST APIとして公開します。これにより、WebアプリケーションやモバイルアプリからJetson上のVLMにアクセスできるようになります。

- Webアプリケーションとの連携: 公開したAPIをWebフロントエンド(React, Vue, Next.jsなど)から呼び出し、VLMの推論結果をユーザーインターフェースに表示したり、次のアクションに繋げたりします。例えば、VLMが生成した説明文をリアルタイムで表示するダッシュボードなどが考えられます。

NVIDIAの公式ドキュメントや、Jetsonコミュニティのフォーラム、GitHubの各モデルのリポジトリには、デプロイに関する具体的なガイドやサンプルコードが豊富にあります。まずは、それらを参考にしながら、小さくても動くプロトタイプを作成してみるのが成功への近道です。

まとめ:WebとAIの未来を切り拓こう!

VLMとJetsonの組み合わせは、エッジAIの可能性を大きく広げ、Web制作・AI開発の現場に新たな価値をもたらします。画像とテキストを理解し、推論するAIがエッジでリアルタイムに動作することで、これまでクラウドでしか実現できなかったような高度なサービスを、より身近で、より低遅延に提供できるようになるでしょう。

Web制作者としては、VLMが提供する画像解析やテキスト生成能力を、ユーザー体験向上やコンテンツ自動化の強力な武器として活用できます。AI開発者としては、エッジデバイスでの最適化やリアルタイム処理のノウハウを深める絶好の機会です。

この技術はまだ発展途上にありますが、だからこそ新しいアイデアや革新的なアプリケーションを生み出すチャンスが無限に広がっています。ぜひ、この最先端の技術に触れ、あなたのWebサービスやAIプロジェクトに新たな息吹を吹き込んでみてください。未来のWebとAIは、あなたの手で創られます!