LLM評価が爆速!NVIDIA NeMo Evaluatorで会話AIの品質を自動チェック

Web制作やAI開発の現場で、最近はLLM(大規模言語モデル)を活用する機会がグッと増えましたよね!

自社のサービスに組み込んだり、特定のドメイン知識でファインチューニングしたり、もうLLMなしでは考えられない!って方も多いんじゃないでしょうか。

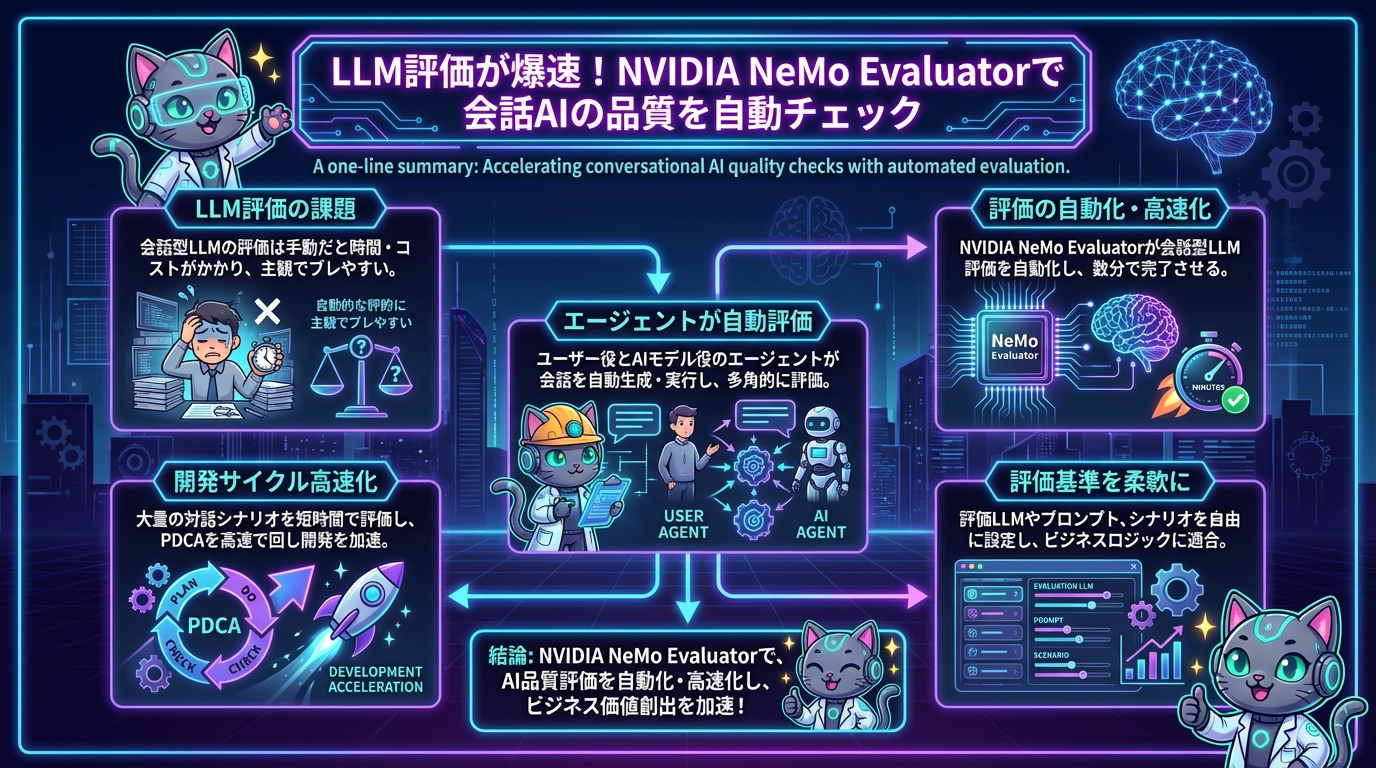

でも、LLM開発って楽しい反面、「評価」が地味に大変じゃないですか?

特に会話型LLMになると、ユーザーとの対話の質、応答の適切さ、一貫性、安全性…と評価項目が多岐にわたる上に、手動でひとつひとつチェックするのは時間もコストもかかるし、評価者の主観が入ってブレやすいのが悩みのタネ。

そんな悩みを抱える開発者さん、Web制作者さんに朗報です!

NVIDIAが提供する「NVIDIA NeMo Evaluator Agent Skills」を使えば、このLLM評価プロセスを劇的に効率化できるんです。「数分で評価」なんて聞くと、にわかには信じがたいかもしれませんが、これがマジで現実になります。

何ができるの? NVIDIA NeMo Evaluatorの超能力

NVIDIA NeMo Evaluator Agent Skillsのコア機能は、ずばり「会話型LLMの評価を自動化・高速化」することです。

- エージェントによる自動評価: 人間が手動で対話シミュレーションを行う代わりに、NVIDIA NeMo Evaluator内のエージェントが「ユーザー役」と「AIモデル役」を演じ、会話を自動で生成・実行します。そして、その対話内容に基づいて、あらかじめ設定した評価基準でAIモデルのパフォーマンスを評価してくれるんです。

- 多角的な評価軸: 単に「正しいか否か」だけでなく、応答の適切性、一貫性、安全性、ユーザー満足度、創造性など、様々な観点から評価が可能です。これにより、より人間らしい、高品質な会話AIを目指せます。

- 高速なフィードバックループ: 大量の対話シナリオを短時間で評価できるため、モデルの変更やプロンプトの調整を行った際の性能変化を即座に把握できます。これにより、開発サイクルが劇的に短縮され、PDCAを高速で回せるようになります。

- 評価基準の柔軟なカスタマイズ: 評価に使うLLM(評価エージェント)や、評価プロンプト、評価シナリオなどを自由に設定できます。自社のビジネスロジックや特定のユースケースに合わせた評価が可能です。

要は、もう評価のために何時間も何日もかけて手動テストする必要がないってこと!

まるで専属のAIテスターチームを雇ったようなものです。

どう使える? Web制作・AI開発での具体例

じゃあ、具体的に僕らの現場でどう活用できるのか、いくつか例を挙げてみましょう。

1. チャットボット開発の品質保証

- 新機能追加時の退行テスト: 新しい会話フローや機能を追加した際に、既存の機能が壊れていないか、応答品質が落ちていないかを自動でチェック。手動では見落としがちなバグも早期に発見できます。

- 特定ドメイン知識の応答精度向上: FAQボットやカスタマーサポートボットで、特定の製品情報やサービスに関する質問に対する応答精度を継続的に評価。新しい情報が追加された際も、評価エージェントが関連質問を投げかけ、回答の正確性を自動で確認できます。

- ユーザーからのネガティブフィードバック分析: ユーザーから「この質問への回答がおかしい」といったフィードバックがあった場合、そのシナリオを評価テストに追加。改善後に問題が解決されたか、他の部分に悪影響が出ていないかを自動で検証します。

- 多言語対応チャットボットの品質比較: 英語、日本語、中国語など、複数の言語でチャットボットを運用している場合、言語間の応答品質や一貫性を比較評価し、品質のばらつきをなくすのに役立ちます。

2. WebサイトのAIアシスタントやレコメンド機能

- FAQ応答の精度向上: Webサイトに埋め込んだAIアシスタントが、ユーザーの質問に適切に答えられているか、誤った情報を伝えていないかを継続的に評価。ユーザー体験の向上に直結します。

- パーソナライズされた商品推奨の質評価: ユーザーの閲覧履歴や購買履歴に基づいた商品推奨が、本当にユーザーのニーズに合致しているかを評価。推薦の精度が売上向上に繋がります。

- ユーザーエンゲージメント向上のための対話フロー改善: AIアシスタントがユーザーとの対話をスムーズに継続できているか、離脱を促していないかを評価。より自然で魅力的な対話体験を提供するためのヒントが得られます。

3. LLMモデルのチューニング・選定

- ファインチューニング後のモデル性能比較: プロダクトに最適なLLMを見つけるため、複数のベースモデルやファインチューニング済みのモデルを比較評価。どのモデルが自社のユースケースに最も適しているかをデータに基づいて判断できます。

- プロンプトエンジニアリングの効果測定: プロンプトのわずかな変更が、LLMの応答にどのような影響を与えるかを迅速に評価。最適なプロンプト設計を効率的に見つけ出すことができます。

これら全てが、手動ではなく自動で、しかも高速に行えるようになるわけです。開発のスピード感、品質の安定度が段違いに向上するのは想像に難くないですよね!

試すならどこから始める?

「おお、これは使えそう!」と感じた方は、早速試してみましょう。

NVIDIA NeMo Evaluator Agent Skillsは、NVIDIAのAIプラットフォーム「NVIDIA NeMo」の一部として提供されています。

- 公式ドキュメントをチェック: まずはNVIDIAの公式ドキュメントで、概要やセットアップ方法を確認するのが第一歩です。

NVIDIA NeMo Evaluator Agent Skillsの具体的なAPIやPython SDKの使い方が詳しく説明されています。 - GitHubリポジトリを探索: サンプルコードや具体的な実装例がGitHubで公開されていることが多いので、これらを参考にしながら自分の環境で動かしてみるのがおすすめです。

- 環境構築: 基本的にはPython環境と、必要なライブラリ(NVIDIA NeMo関連など)をインストールすることになります。GPUを活用するツールなので、NVIDIA GPU環境があることが前提となりますが、クラウド環境(AWS, Azure, GCPなど)でNVIDIA GPUインスタンスを利用するのも良いでしょう。

- シンプルな評価シナリオからスタート: 最初から複雑な評価をするのではなく、まずは「特定の質問に対する回答が正しいか」といったシンプルなシナリオから評価エージェントを構築し、動かしてみるのが成功の鍵です。

NVIDIA NeMo Evaluator Agent Skillsを導入することで、LLM開発における評価のボトルネックが解消され、より高品質なAIサービスを、よりスピーディに市場に投入できるようになります。

これはWeb制作やAI開発に携わる私たちにとって、まさにゲームチェンジャーとなるツールです!

ぜひこの機会に、NVIDIA NeMo Evaluator Agent Skillsを試して、あなたの開発ワークフローを次のレベルへと引き上げてみてくださいね!