AWSで基盤モデル開発を加速!OSS活用と新たなスケーリング法則を理解する

基盤モデル開発のフロンティア:スケーリングの常識が変化

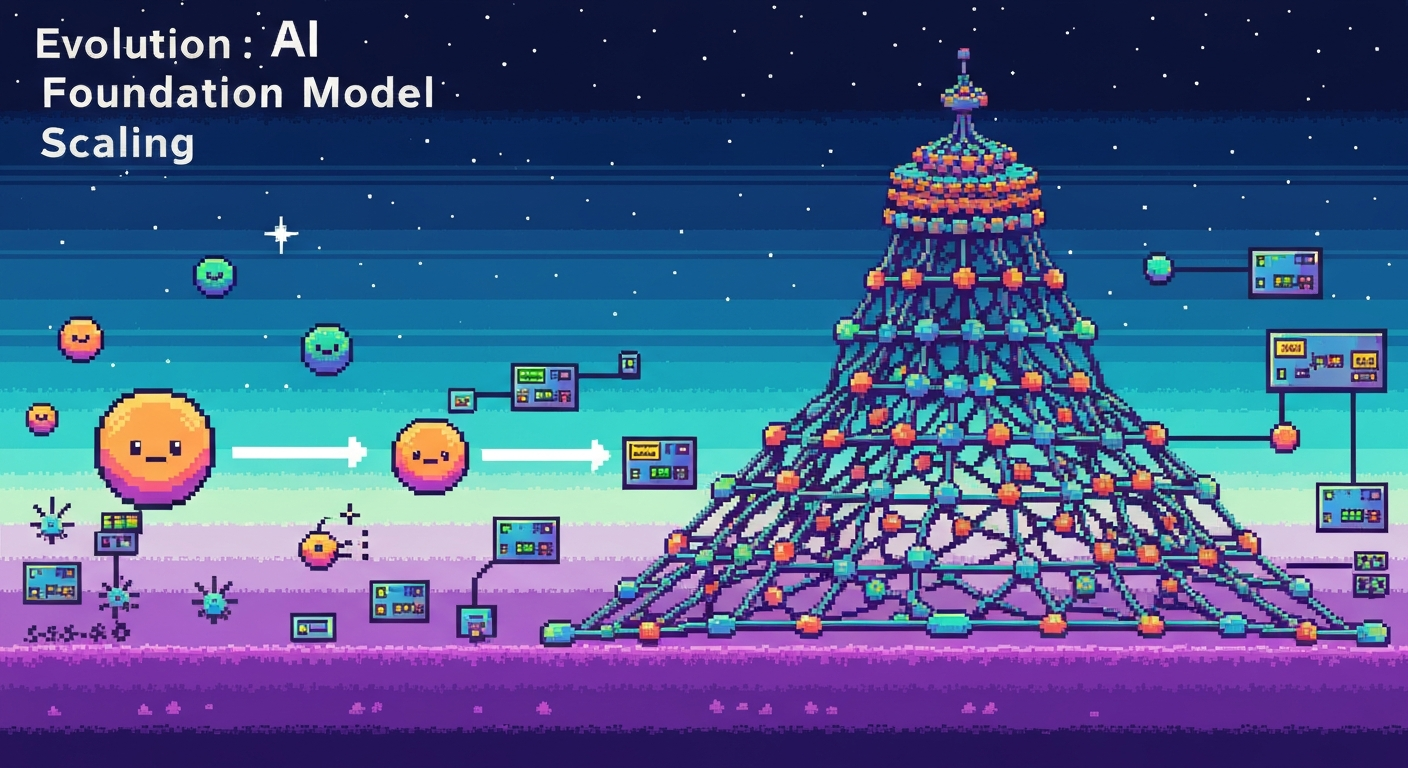

大規模な基盤モデル(Foundation Model)の開発において、かつては「事前学習に多くの計算資源を投入すれば、能力が向上する」という考え方が主流でした。Kaplan et al. (2020) のような研究がこれを裏付け、モデルパラメータ、データセットサイズ、トレーニング計算をスケールさせることで、損失が予測可能なパワーローで減少すると報告されていました。この直感は、大規模なアクセラレータ容量と、それを効率的に活用するための分散インフラへの継続的な投資を正当化してきました。

しかし、現在の基盤モデル開発のフロンティアは進化しています。もはやスケーリングは単一の曲線ではありません。NVIDIAの「AI's Three Scaling Laws, Explained」が示すように、パフォーマンスは事前学習だけでなく、事後学習(教師ありファインチューニング (SFT) や強化学習 (RL) ベースの手法など)や、推論時の計算(「ロングシンキング」、探索/検証、マルチサンプル戦略など)によっても向上する時代へと移行しています。

これらの新しいスケーリングのアプローチは、基盤モデルのライフサイクル全体(事前学習、事後学習、推論)において、インフラに対する収束した要件をもたらします。具体的には、密結合されたアクセラレータ計算、高帯域幅で低遅延なネットワーク、そして分散ストレージバックエンドが不可欠となります。また、リソース管理のためのオーケストレーションと、クラスターの健全性を維持し、大規模なパフォーマンス問題を診断するためのアプリケーションレベルおよびハードウェアレベルの可観測性(オブザーバビリティ)の重要性が高まっています。

さらに、基盤モデルのライフサイクルは、モデル開発フレームワーク、クラスターリソース管理、運用ツールにわたるオープンソースソフトウェア(OSS)エコシステムへの依存を深めています。このブログ記事では、基盤モデルのトレーニングと推論に関わる機械学習エンジニアや研究者の皆さんが、OSSフレームワークを基盤としたワークフローで、これらの進化する要件にどのように対応できるかを探ります。

何ができるのか

基盤モデルの性能向上は、もはや事前学習だけではありません。以下の3つのフェーズでスケーリングを行うことで、より強力で効率的なモデルを構築できるようになります。

- 事前学習(Pre-training): 大規模なデータセットと計算資源を用いてモデルの基礎能力を構築します。これは引き続き重要ですが、唯一のアプローチではありません。

- 事後学習(Post-training): 事前学習後のモデルを、特定のタスクや振る舞いに合わせて調整します。教師ありファインチューニング(SFT)や強化学習(RL)ベースの手法がここに含まれます。これにより、モデルの応用範囲や精度を大幅に向上させることが可能です。

- 推論時の計算(Test-time compute): モデルが予測を行う際に、より多くの計算リソースを投入することで性能を高めます。「ロングシンキング」と呼ばれる手法や、探索・検証、複数のサンプルを生成して最適なものを選択するマルチサンプル戦略などが該当します。これにより、推論の質や信頼性を向上させることができます。

これらのスケーリングのアプローチは、インフラ面で共通の要件を持っています。具体的には、高性能なアクセラレータ計算資源が密結合され、これらを結ぶ高帯域幅・低遅延なネットワーク、そして大規模なデータを扱うための分散ストレージバックエンドが必要です。また、これらの複雑なリソース群を効率的に管理するためのオーケストレーションと、クラスター全体の健全性を監視し、問題が発生した際に迅速に診断するための可観測性(オブザーバビリティ)が極めて重要になります。

これらの機能は、PyTorchやJAXのようなモデル開発フレームワーク、SlurmやKubernetesのようなクラスターリソース管理ツール、そしてPrometheusやGrafanaのような運用ツールといった、広範なOSSエコシステムによって支えられています。このOSSスタックが、基盤モデルのライフサイクルを横断的にサポートする積層アーキテクチャを形成しています。

どう使えるのか(具体例)

基盤モデル開発の進化に対応するため、開発者は以下のOSSツールとアーキテクチャを活用できます。

- 計算資源の効率的な管理とオーケストレーション

大規模な基盤モデルの学習や推論には、GPUなどのアクセラレータが不可欠です。これらの貴重な計算資源を効率的に割り当て、利用するためには、SlurmやKubernetesのようなクラスターリソース管理システムが役立ちます。これらのツールを使うことで、複数のユーザーやジョブ間で計算資源を適切に共有し、利用率を最大化できます。例えば、Kubernetes上でPyTorchの分散学習ジョブを実行し、複数のGPUインスタンスにわたってモデルを学習させるといったことが可能になります。 - モデル開発と分散学習の最適化

基盤モデルの開発とトレーニングは、PyTorchやJAXといったMLフレームワークを通じて行われます。これらのフレームワークは、分散学習の機能を提供しており、高帯域幅・低遅延ネットワークと組み合わせることで、数十から数百のアクセラレータを使った大規模なモデル学習を効率的に実行できます。これにより、モデルパラメータの増加やデータセットの拡大に対応し、事前学習や事後学習のフェーズを加速させることが可能です。 - クラスターの健全性とパフォーマンスの可視化

複雑な分散システムである基盤モデルの学習・推論クラスターを運用する上で、その健全性を維持し、パフォーマンスのボトルネックを特定することは非常に重要です。ここで力を発揮するのが、PrometheusとGrafanaの組み合わせです。PrometheusでCPU使用率、GPU使用率、ネットワーク帯域幅、ストレージI/Oなどのメトリクスを収集し、Grafanaでそれらを視覚的にダッシュボード化することで、クラスターの状態を一目で把握できます。また、Grafanaのアラート機能を使えば、異常を検知した際に即座に通知を受け取ることができ、パフォーマンスの低下や障害発生時に迅速な対応が可能になります。これは、アプリケーション層からハードウェア層まで、全てのレイヤーにわたる可観測性を提供し、大規模な基盤モデル運用における「なぜ遅いのか」「どこがボトルネックなのか」といった疑問への答えを見つける手助けとなります。

これらのOSSツール群は、基盤モデルのライフサイクル全体を支える積層アーキテクチャを形成し、開発者が進化するスケーリングの課題に対応できるよう支援します。

試すならどこから始めるか

基盤モデル開発における新たなスケーリング戦略とOSSエコシステムの活用を始めるにあたり、以下のステップを検討してみてください。

- 現在の課題と目標の特定

まずは、ご自身の基盤モデル開発ワークフローにおいて、どのスケーリングフェーズ(事前学習、事後学習、推論)で最も性能向上や効率化の余地があるかを特定することから始めましょう。例えば、モデルのファインチューニングの精度が課題であれば事後学習、推論レイテンシーが課題であれば推論時の計算に焦点を当てることになります。 - OSSツールの調査と導入

目標に応じて、具体的なOSSツールの導入を検討します。- リソース管理の課題: 大規模なアクセラレータクラスターの効率的な管理に課題がある場合、KubernetesやSlurmの導入を検討します。特にKubernetesは、コンテナ化されたワークロードのオーケストレーションに広く利用されており、MLワークロードにも適しています。

- モデル開発と学習の課題: 大規模なモデルの分散学習を効率的に行いたい場合、PyTorchやJAXといったフレームワークの分散学習機能に習熟することが重要です。これらのフレームワークが提供するAPIやツールを学ぶことから始められます。

- 運用の可視化と診断の課題: クラスターの健全性やパフォーマンスのボトルネックを把握したい場合、PrometheusとGrafanaの導入は非常に効果的です。まずは小規模な環境でこれらのツールをセットアップし、基本的なメトリクス収集と可視化から始めることをお勧めします。これにより、運用中の問題を早期に発見し、迅速に対応するための基盤を構築できます。

- AWSインフラの活用

これらのOSSスタックは、AWSの堅牢なインフラ上で強力に機能します。AWSは、密結合されたアクセラレータコンピューティング、高帯域幅・低遅延ネットワーク、そしてスケーラブルな分散ストレージバックエンドを提供し、基盤モデルのライフサイクル全体をサポートします。具体的なAWSサービスに言及することはできませんが、これらのインフラ基盤が、上記のOSSツール群を最大限に活用するための土台となることを理解しておくことが重要です。

特に、大規模な基盤モデルを運用する上では、初期段階からオブザーバビリティの導入を検討することが推奨されます。PrometheusとGrafanaの組み合わせは、クラスターの状態を可視化し、パフォーマンスの問題を診断する上で強力なツールとなり、将来的なスケーリングと安定運用に不可欠な要素となるでしょう。

基盤モデル開発のフロンティアは常に進化しています。OSSエコシステムと適切なインフラを組み合わせることで、この変化の波を乗りこなし、より高性能で効率的なモデル開発を実現できるはずです。